2024年10月23日~25日に幕張メッセで開催された「第10回 IoT・エッジコンピューティングEXPO秋」に、Synaptics社とマクニカが共同出展しました。本展示会のテーマであるエッジコンピューティングはさまざまな目的で導入が進んでいますが、それと同時にAI開発に課題をお持ちの方も増えています。

今回、マクニカとして初めての共同出展となったSynaptics社は、1986年にアメリカ合衆国カリフォルニア州サンノゼに設立された、IoTとAIの革新をリードする総合ソリューションプロバイダーです。

本展示会でSynapticsに興味を持っていただいた方には振り返りとして、また、ご来場されなかった方にはSynapticsについて知っていただけるように、イベントレポートを公開させていただきます。是非最後までお読みください。

ブースでは、以下5つのデモンストレーションをご覧いただきました。

1.顔・物体検知/姿勢推定

2.10画面同時映像出力

3.人物検出

4.Bluetooth距離測定

5.Wi-Fi 人物検出

PDFファイルはこちら

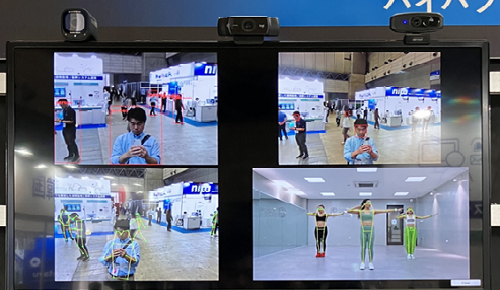

1.顔・物体検知/姿勢推定

ここからは、各デモンストレーションの内容についてご紹介します。

こちらは、Synaptics社AIプロセッサー SL1680を搭載した評価ボードにて、エッジ環境で複数のAIモデルを同時処理させるデモンストレーションです。3つのウェブカメラで撮影した映像と内部に保存した動画に対して同時にAI画像処理を行い、結果をディスプレイに表示しています。

デモンストレーションの画面に対して、

・左上が物体検知デモ

・右上が顔検知デモ

・下二つが骨格検知デモ

となります。

AIモデルはオープンソースのYoloを使っていますが、独自に構築やチューニングすることにより、さらに高度な処理をさせることも可能です。

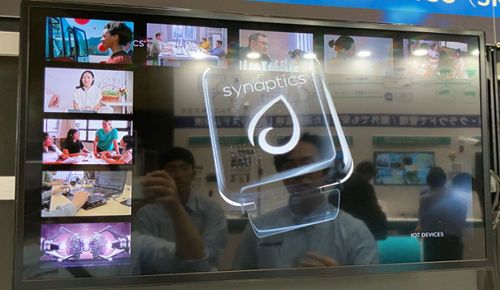

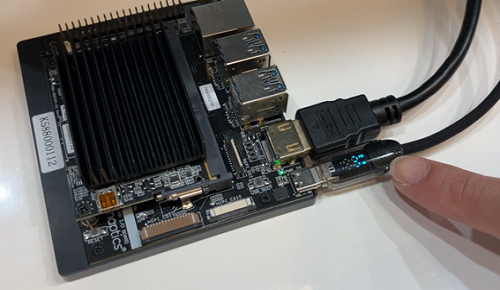

2.10画面同時映像出力

こちらも「1.顔・物体検知/姿勢推定」と同様に、Astra SL 1680を使ったデモンストレーションです。こちらのデモンストレーションではAI技術は使っていませんが、Astra SL 1680に搭載されたハードウェアデコーダーを使ってH.264から同時に10個の動画をデコードして表示しているにも関わらず、評価ボード全体で3Wクラスの低消費電力を実現しています。

デジタルサイネージのようなアプリケーションで、広告表示と合わせてカメラセンサーを取り付け、映像をAI処理して広告を見ている人の情報を分析することで、効果的なマーケティングを実現するような活用方法が期待されています。

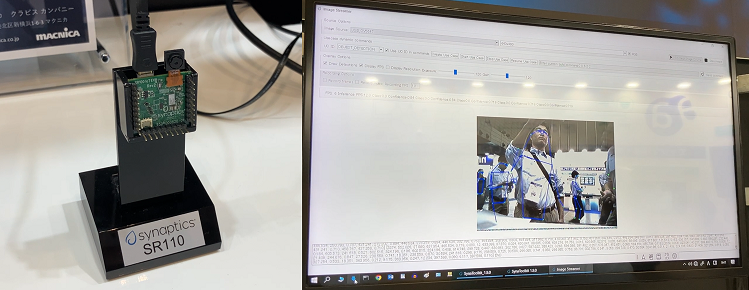

3.人物検出

こちらはAstra SR110による人物検出のデモンストレーションです。市場で流通しているエッジAIプロセッサー・マイコンはLinuxでの動作が必須となる製品が多いと思いますが、SR110はRTOSで動作するマイコンです。

プロセッサーと比べると処理能力は落ちますが、軽いAIモデルでの画像処理レベルであれば問題なく動作します。CやC++でアプリケーションソフトウェアを記述できるため、従来のマイコン開発と変わらない環境で開発が可能であることが特徴となります。

また、プロセッサーのような大規模チップと比べ消費電流が大幅に少なく、画像のデモでは約100mW程度での動作が可能でございますので、バッテリー駆動の機器や、ホストプロセッサーへ画像を入力する前処理用途などに適しています。

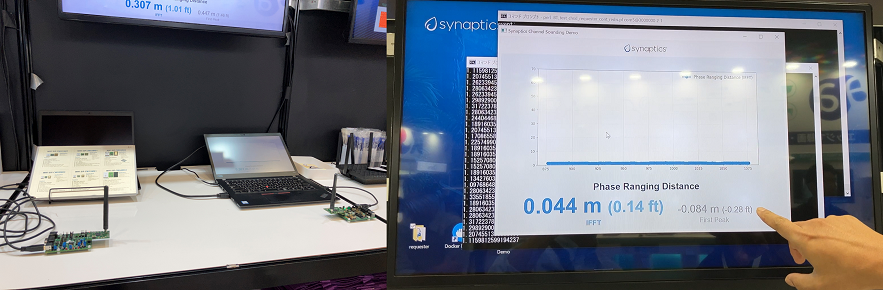

4.Bluetooth距離測定

こちらのデモンストレーションでは、Bluetooth6.0のChannel Soundingという、2024年に規格化された測距技術をご覧いただけます。BluetoothのLong Rangeという機能を使って、見通しが良ければ最大で約100メートルの測距が可能で、近距離であれば30~50cm程度の精度が期待できます。画面上では、実際に測定した距離が表示されています。

この技術の応用例として、車のデジタルキーが考えられています。現在は主にUWBが使われていますが、さまざまな周波数帯で常時スキャンするために消費電力が大きくなることが課題となっています。その対策として、UWBの横にBluetoothを配置し、距離が遠いときはBluetooth、近いときはUWBが使われています。Bluetoothの測距精度が上がることで、UWBを無くすことができると期待されています。

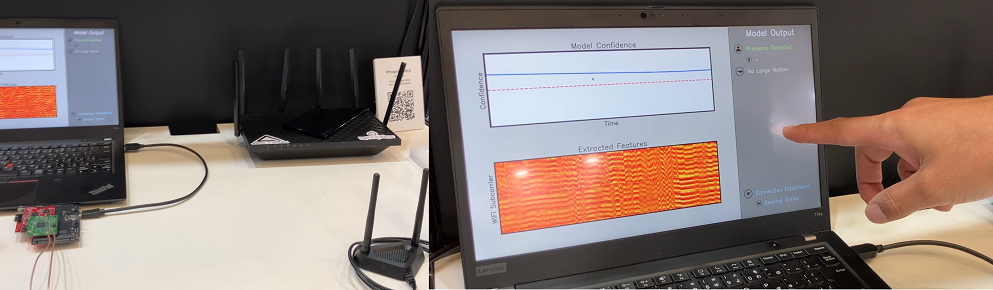

5.Wi-Fi 人物検出

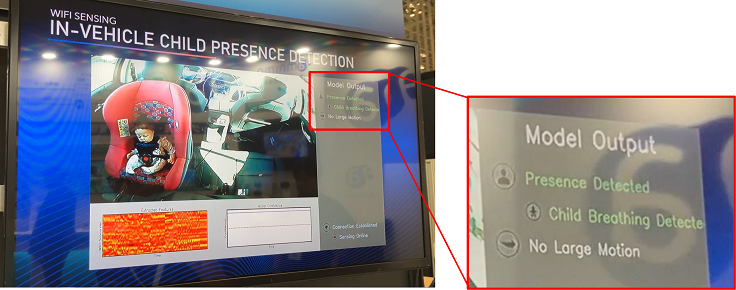

こちらはWi-Fi Sensingのデモンストレーションになります。アクセスポイントとクライアントが接続されており、1秒間に100回通信しています。このデモンストレーションでは電波の状態を見て、画面上に表示しています。

縦軸がサブキャリア、横軸が時間、色が振幅強度を表しています。

赤い線がConfidence Level、青い色が現在地を表しており、青い線が赤い線の上にあると人がいることを、青い線が下だと人がいない状態を表しています。アンテナを握って電波を遮断すると、画面上に表示される波が変化する様子が確認できます。

この技術の応用例として車内の子供の検出があります。子供が置き去りになって亡くなる痛ましい事故は日本に限らず起きていますが、それを無くすための技術として期待されています。この映像では、カーナビにWi-Fiアクセスポイント、後部座席頭上に通信デバイスを設定して、車内を検知する環境を構築しています。

カメラの映像では赤ちゃんが隠れてしまうと検知できなくなってしまいますが、Wi-Fiの電波を活用することで赤ちゃんが見えない位置でも検出が可能になります。

人がいる・いないを検出するだけではなく、子供と大人の呼吸の違いを検知することで検知対象が子供なのか、大人なのかを見分けることができるようになります。

来場者の声

「AIの開発環境を探しており、Astra Machinaの機能やコスト感、さらにポータルを使ったHOW TOに魅力を感じた。」

「SR110が非常に低消費電力であることに驚いた」

「ホテルの客室など個人情報保護の観点でカメラが使えないため、Wi-Fi Sensingに興味を持った」

など、組み込み機器の設計開発に携わる方はもちろんのこと、AIの活用を検討するさまざまな業界のエンドユーザーの方々にも興味を持っていただくことができました。

お問い合わせはこちら

最後までお読みいただきありがとうございました。本記事でご紹介したデモンストレーションを実際にご覧になりたい方、SynapticsのAstraシリーズやWi-Fi、Bluetoothのソリューションに興味がある方はぜひお問い合わせください。