本記事は、デジタル音声がどのように記録され、どこで情報が失われるのかを、サンプリングと量子化の観点から整理したものです。

アナログの連続した音が、“点(サンプリング)”と“段階(量子化)”だけで表現されると何が起きるのか。実際の音の変化や波形の見方を通して、音(情報)が失われる仕組みと、その理由を理解することを目的としています。

デジタル音声で“情報が失われる仕組み”とは何か

アナログ音声は、時間方向にも振幅方向にも連続的に変化する情報です。しかし、デジタル機器が扱えるのは 離散的な数値データ だけです。そのため、アナログ音をデジタルに変換する際にはサンプリング と 量子化 の2段階の処理がおこなわれ、この2つの処理によって一部の情報が必ず失われます。

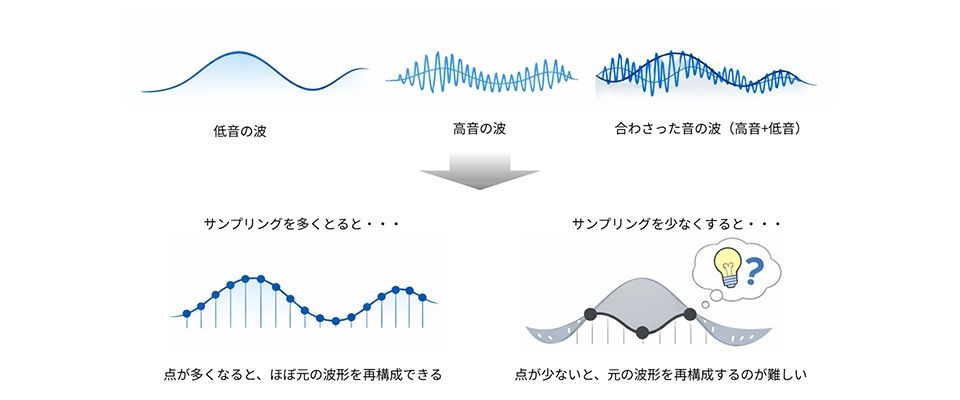

■ サンプリング:時間方向の情報を等間隔で切り取る

アナログ波形を一定周期で「点」として記録します。このとき、点と点の間にある細かな波の変化は記録されず、時間方向の情報の一部が捨てられます。

■ 量子化:振幅方向の細かな違いを段階に丸める

記録した点の振幅(音の大きさ)を、あらかじめ決められた段階数に丸めて保存します。段階が粗いほど、元の波形の滑らかさは失われます。

サンプリング:時間方向の情報がどこで失われるのか

アナログ音声は、時間方向に連続して変化する波(信号)です。しかしデジタル化では、波の形を一定の時間間隔で“点”として記録する(サンプリング)必要があります。この「時間を刻む」という処理によって、点と点のあいだにある細かな変化が記録されないため、時間方向の情報が一部失われます。

サンプリング周波数の 44.1kHz と 8kHz では何が聴こえなくなるか

声や楽器の音は、ゆっくり揺れる成分(低い音)と、細かく揺れる成分(高い音)が混ざってできています。高い音ほど波の揺れが細かいため、短い間隔で記録しないと、その揺れは取りこぼされます。サンプリング周波数は、1秒間に音を何回記録するかを示す値です。

例:

・44.1kHz → 1 秒間に 44,100 回記録

・8kHz → 1 秒間に 8,000 回記録

点の間隔が広くなると、その間にある 細かい揺れ(=高い周波数成分)を“見る前に通り過ぎてしまう” ため、記録されません。その結果、8kHzでは次のような変化が起こります。

・S、H のような子音が弱くなる

・高音の広がりや空気感が消える

・全体的に「こもった」印象になる

8kHzでは、「細かい揺れ」=「高い周波数の音」が最初から点として記録されていません。これを波形で見ると、"別の波"に見えてしまいます。

高周波が落ちる理由:ナイキスト周波数とは?

サンプリングでは、音の波を一定間隔の点として記録します。この点の間隔より細かく揺れている部分(=高音)は、前出の図のように 点と点のあいだに隠れてしまい記録されません。波が1回揺れたと判断するには、“上がる” と “下がる” の2つの変化が必要です。つまり、1つの周期をとらえるには 最低2点の記録 が必要になります。

そのため、

・44.1kHz なら 約22kHz

・8kHz なら 約4kHz

と、サンプリング周波数の半分 までしか細かい揺れを記録できません。これが “ナイキスト周波数” と呼ばれる限界で、高周波が先に落ちてしまう理由です。またこれは、元の波形を正確に再現するには、2倍以上の周波数でサンプリングする必要があるということも意味しています。

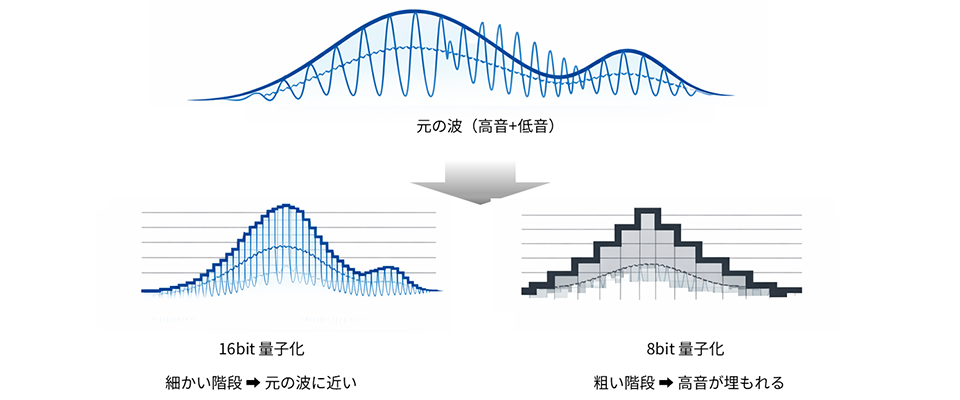

量子化:振幅方向の情報がどこで削られるのか

デジタル化では、音の“波の高さ(振幅)”をあらかじめ決められた段階(ステップ)に丸めて記録します。この処理を「量子化」と呼びます。段階が細かいほど、波の高さを細かく表現できます。逆に段階が粗いと、近い高さの違いが全部同じ扱いになってしまい、波が“階段状”にカクカクした形になります。

量子化は、サンプリングが「横方向(時間軸)」の細かさを決めるのに対し、「縦方向(高さ)」の細かさを決める部分です。この仕組みが、「8bit音がザラつく」「小さな音が消える」といった現象の根っこになります。

8bit で音がザラつく原因

8bit と 16bit の違いは、波の高さを何段階で表現できるかの違いです。

・16bit → 65,536段階

・8bit → 256段階

段階が粗い (8bit) ほど、高さの丸め誤差が大きくなり、波がギザギザになります。

これが、

・音がザラつく

・小さな揺れ(高音)が消える

・立ち上がりが丸まる

といった“8bit特有の音質”になる理由です。

波形で見る量子化誤差:ギザギザになる仕組み

下図の中央上の波は、低音(ゆっくり)と高音(細かい揺れ)が混ざった“元の波”です。16bit 量子化(左下図)では段階が細かいため、高さを丸めても元の波にほぼ近い形で再現できます。しかし 8bit 量子化(右下図)では、段階が粗いため、細かい高さの違いが段階内に吸収されてしまいます。

その結果、

・波が“階段状のギザギザ”になる

・細かい揺れ(高音)は段階に埋もれて消える

・低音だけが残った“丸い別の波”のように見える

下図がそのままこれを視覚的に示しています。

ダイナミックレンジとノイズフロアの関係

量子化ビット数が増えると、波の高さを表現できる段階数が増え、小さな音(弱い信号)も段階として記録できるようになります。一方、段階が粗い 8bit では、弱い音の振幅は段階に埋もれてしまい、“0” として扱われることがあります。この「これ以下の小さな音は記録できない」という境界のことをノイズフロア と呼びます。

・ノイズフロアより下の小さい音 → 消える(段階に埋もれる)

・ノイズフロアより上の音 → 段階で表現される

結果として、

・16bit → ノイズフロアが低い

→ もっと小さな音まで表現できる

→ ダイナミックレンジ(表現できる音の幅)が広い

・8bit → ノイズフロアが高い

→ 小さな音が消えやすい

→ ダイナミックレンジが狭い

また、段階の粗さそのものが量子化ノイズ(シャリシャリした背景ノイズ)として現れます。

波形から“原因が説明できる”ようになると何が変わるか

サンプリングと量子化を理解すると、音の変化を“なんとなく”ではなく、波形のどの部分が失われているのかという視点で説明できるようになります。これは、音声の設計や評価で“勘”ではなく“根拠”で判断できるようになることを意味します。

ここでは、その理解が実際の開発でどんな力になるのかを簡単に紹介します。

■ マイク・ADCの評価観点が分かりやすくなる

サンプリングと量子化を理解すると、「なぜ音がこう聞こえるのか?」を波形を見ながら説明できるようになります。

例:

・高音が落ちているのは“サンプリングの刻み”の問題

・小さな音が埋もれるのは“ビット深度の刻み”の問題

といったように、どの設定が音のどの部分に影響しているかが自然に分かるようになります。これだけで設計判断がだいぶ楽になります。

■ ノイズ対策が “なんとなく” から卒業する

波形を見る力がつくと、「ノイズっぽい」「ザラザラする」といった曖昧な表現ではなく、

・それが“細かい揺れの欠落”によるものなのか

・“段階の粗さ”によるものなのか

といった 原因の見当がつくようになります。そのため、次に何を調整すればいいのかが分かりやすくなります。

■ 音声認識・圧縮の前処理の意味が理解しやすくなる

音声認識や圧縮では、必ず「不要な揺れを消す」「必要な部分だけ残す」という処理をしています。サンプリングと量子化を理解していると、「なぜその処理が必要なのか」が直感的に理解できるようになり、設定やチューニングの意図が読み取りやすくなります。

まとめ:音の劣化は必ず理由がある。それを掴むのが最初の一歩

デジタル音声の劣化は、「なんとなく起きるもの」ではありません。サンプリングでは 時間方向の細かな揺れ が、量子化では 高さの細かな違い が削られます。つまり、音の変化には 必ず“波形のどこが失われているか”という原因がある ということです。

今回の内容を通して、

・高音が落ちる理由

・音がザラつく理由

・小さな音が消える理由

・別の波に聞こえる理由

これらがすべて“波形とデジタル化の仕組み”と結びついていることが分かったはずです。この理解があるだけで、日々の評価・設計・トラブルシュートは勘ではなく根拠にもとづいて判断できるものに変わります。デジタル音声を扱ううえで、サンプリングと量子化は最初に押さえるべき「入口」ですが、ここを理解できていると、今後扱う「ノイズ対策」「フィルター処理」「音声認識の前処理」「コーデックや圧縮方式」といったテーマも格段に理解しやすくなります。

音がどう変わって聞こえるのかには必ず理由があります。その理由を波形で説明できるようになることが、“音を扱える” 技術者への最初のステップです。

関連情報

ここまで説明してきた「サンプリングと量子化」を経て、デジタル化した“音を扱う”時には、オーディオ開発プラットホームが便利です。DSP Concepts のオーディオ開発プラットホーム「Audio Weaver」は、音の補正や拡張など“音を扱う”と言うことが、GUI ベースで容易にできます。

お問い合わせ

本記事についてご質問などありましたら、以下よりお問い合わせください。

DSP Concepts メーカー情報 Top へ

DSP Concepts メーカー情報 Top ページへ戻りたい方は、以下をクリックください。