※本記事は、DSP Concepts社のエンジニアが作成したブログをマクニカで和訳したものになります。

エッジコンピューティングでは、サービスの提供とデータ処理がクラウドプロバイダー経由ではなく、ローカルネットワークの「エッジ」でおこなわれるため、近年、クラウドコンピューティングからの移行が促進されています。情報のセキュリティとプライバシー、レイテンシーの低減、インテリジェントアプリケーションの増加は、インフラストラクチャーやエンタープライズおよび消費者市場の垂直分野にエッジデバイスを採用する主な理由です。Allied Market Researchの調査によると、世界のエッジコンピューティング市場は年間約33%成長すると予測されています。

消費者は、音声対応製品の利点を認識しています。音声インターフェースは、利便性を重視する人だけでなく、衛生上の懸念からタッチベースのコントロールを使い続けることに抵抗がある人にも魅力的です。しかし、プライバシーや精度、さまざまなアクセントや方言を認識するデバイスの能力に関する懸念が、こうした製品の普及を妨げています。

2020年に調査された消費者の75%が、何らかのレベルの懸念を報告しており、30%が「非常に懸念している」と回答しています。ユーザーのプライバシーに関する不安は、克服すべき大きな障壁の一つです。従来の音声認識システムでは、言語のカバレッジもユーザーの主要な懸念事項であり、異なるアクセントでの認識が不正確であることから生じる不満もあります。

Arm Cortex-Mシリーズプロセッサーは、エネルギー効率と低コストを念頭に置いて設計されており、フィットネストラッカーから電池式リモコン、家電製品まで、幅広い組込みアプリケーションに音声制御機能を構築するための理想的なターゲットプラットフォームを提供します。これらのプロセッサーにより、製品メーカーはコスト効率と効率性に優れた音声対応製品を提供する機会を得ますが、上記の分野での信頼性の欠如に対処するソリューションを提供することがますます重要になっています。

Fluent.aiとDSP Conceptsは、正確でノイズに強い音声認識を

Armベースのプラットフォームのエッジにもたらします!

ノイズの多い環境で、このソリューションは洗濯機、HVAC、ファンフードなどのソースからのノイズを克服し、近距離(1 m以内)でのウェイクワードとコマンドの認識において非常に高い精度を実現します。Fluent.aiのテクノロジーを使用したマルチマイク設計により、遠距離(3m以上)でも同様のパフォーマンスを得ることができます。

TalkToは、高度な信号処理技術を組み合わせて、音声アシスタントや音声認識エンジンにクリーンなオーディオ信号を提供します。TalkToの機能は、幅広い設計要件、プラットフォームの制限、音響環境、ユースケースに合わせたスケーリングに合わせて調整できます。Fluent.ai Wakeword および Fluent.ai “Air” 音声意図認識モデルと組み合わせて使用することで、このオーディオフロントエンド (AFE) は、堅牢なノイズ除去機能を備えた正確で信頼性の高い音声インターフェースを提供します。

Audio Weaverは、音声対応製品の構築と開発のプロセスを加速し、簡素化する、ローコード/ノーコードのオーディオ開発プラットフォームです。Audio Weaver を使用すると、プラットフォームに依存しないデザインを開発することができ、その設計をやり直すことなく、さまざまな対象製品に展開できます。これにより、ハードウェアを使用しないオーディオ設計の迅速なテストと反復作業が可能になり、開発者は後から並行して最終製品設計にシームレスに個別機能実装の作業ができます。

Fluent.ai Airは、1つのシステムで複数の異なるアクセントと言語をサポートする正確でノイズに強い音声認識を提供し、メモリーサイズやCPUクロック速度を犠牲にすることなく、アクセントに敏感なシステムに関する消費者の懸念に対処します。このシステムの言語的な柔軟性により、メーカーはコスト効率の高いプロセッサーを利用して、幅広い地域の市場に単一のSKUを展開し、コストと開発/ローカライズ時間の両方を節約できます。

プライバシーは、このソリューションが対処するもう1つのユーザーの懸念事項です。エッジベースの音声対応デバイスは、オフラインまたはネットワークの周辺で動作するため、クラウドとの送受信を必要としない密閉されたシステムとして動作します。このローカル操作の方法により、コマンドの認識と処理の待機時間が大幅に短縮され、設計上プライベートなシームレスなユーザーエクスペリエンスが可能になります。

Fluent.aiとDSP Conceptsが提供するソフトウェアソリューションの組み合わせは、任意のArm Cortexシリーズプロセッサーに導入でき、省スペースのCortex-Mシリーズに適しています。

どのように機能するか?

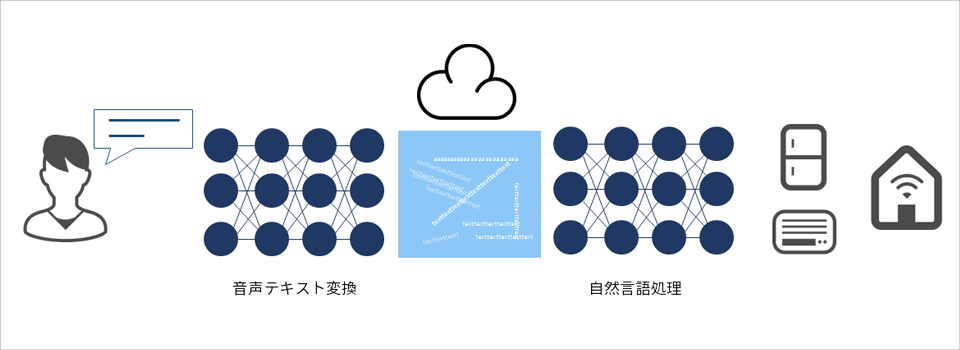

従来の自動音声認識 (ASR) モデルは、音声をテキストに変換し、ターゲット言語でクラウドベースの自然言語処理を利用してユーザーの意図を判断します(図1)。このアプローチでは、大量のデータを送信し、大量のコンピューティング能力を使用する必要があります。さらに、ASRに対するこのアプローチでは、自然な対話を妨げる程の遅延が発生してしまいます。

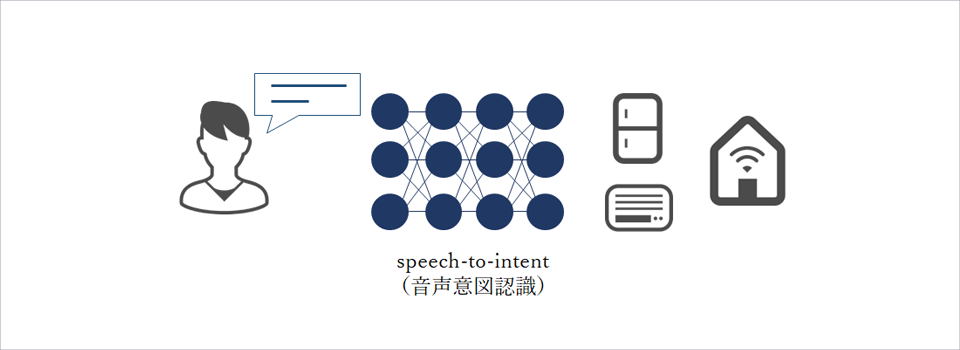

Fluent.aiは、従来のモデルに存在するコンピューティングフットプリント、信頼性、および遅延の問題を解決しようとするモデルを開発しました。独自のニューラルネットワークアルゴリズムを採用しているFluent.aiのspeech-to-intent(音声意図認識)アプローチは、言語とアクセントに依存せず、音声をテキストに変換したり、クラウドベースの自然言語処理を利用したりすることなく、受信した音声に基づいて意図されたアクションを決定します(図2)。このモデルは、インターネット接続やサードパーティーの言語処理に依存することなく、エッジで動作します。

Fluent.ai Wakeword、Fluent.ai Air、DSP Concepts Audio Weaver、DSP Concepts TalkTo の組合わせは、ノイズに強い多言語音声ユーザー インターフェース (VUI) を構成し、白物家電製品やその他の製品のメーカーにとって理想的なソリューションとなります。

私たちはこれからどこへ行くのか?

VUIの次の段階は、コマンドを「人間よりも優れた」レベルで理解し、環境ノイズをカットして言語やアクセントに関係なくユーザーの意図を判断し、カスタマイズされたフラストレーションのないユーザーエクスペリエンスを提供する可能性を秘めています。

DSP Conceptsは、Audio Weaverプラットフォームの柔軟性により、プログラミング、リアルタイムデバッグ、チューニングのためのエンドツーエンドのソリューションを開発者に提供し、さまざまなユースケースに対応したエッジベースのVUIを作成するために必要な開発オーバーヘッドを削減します。

Fluent.aiはDSP Conceptsと提携し、Arm Cortex-M4および-M7ベースのデバイスで音声対応ソリューションの開発者にこの柔軟性と使いやすさを提供します。

おすすめ関連記事

お問い合わせ

本記事に関して、ご質問などありましたら以下よりお問い合わせください。

DSP Concepts メーカー情報 Top へ

DSP Concepts メーカー情報 Top ページへ戻りたい方は、以下をクリックください。