● 本記事のポイント ●

- ChatGPTの生まれた背景や業務活用事例、利用時の注意点・リスクなど全体像が分かる

- 社内向けのChatGPT勉強会で抑えるべきポイントが分かる

- 勉強会でそのまま使える資料PDFが入手できる(無料)

こんにちは、マクニカAIエンジニアの佐々木です。

ChatGPTが社会的に盛り上がりを見せていますね。社内でAIに携わるエンジニア、情報システム部門のみなさんにはChatGPTが何なのか事業部門へ説明してほしいという依頼が殺到しているのではないかと想像しています。

ただ、いざ説明しようとすると、日々の業務をこなしながら、頭の中にあるものをわかりやすく資料に落とすのはなかなか時間も手間もかかり困っている方もいるのではないかと思っています。

なぜかというと、私も他部門から突然依頼を受け、全社に対して勉強会を実施したからです!

そこで今回、同様の依頼を受けた際に、私たちの情報が皆さまの助けになるのではないかと考え、勉強会に使用した資料を一般に公開することにしました。

尚、資料は発表ノートを記載したものと、記載していないものの2種類用意しました。発表ノートには発表トークの参考例を具体的に記載しています。スライドだけでは分かりにくい内容や背景を発表トークで補うことを意識して記載しています。発表の際の参考にしていただければと思います。

この資料がみなさんのお役に立つことができれば幸いです。

ChatGPT社内勉強会資料

以下に、本資料のポイント、想定対象者、および説明時のポイントについて記載しますので、社内説明時の参考資料としてご利用ください。

資料のポイント

- ChatGPTの業務活用のきっかけとなるよう事例を紹介

- 利用にあたっての注意点やリスクを紹介

- 全体像がわかることを優先し、技術的な詳細にはあまり踏み込まない

- ChatGPTが生まれた背景やOpenAIについても少しは盛り込む

想定対象者

本資料は、社内の情報システム部門など、IT関連の部署担当者が社内部門向けに説明をすることを想定しています。

説明のポイント

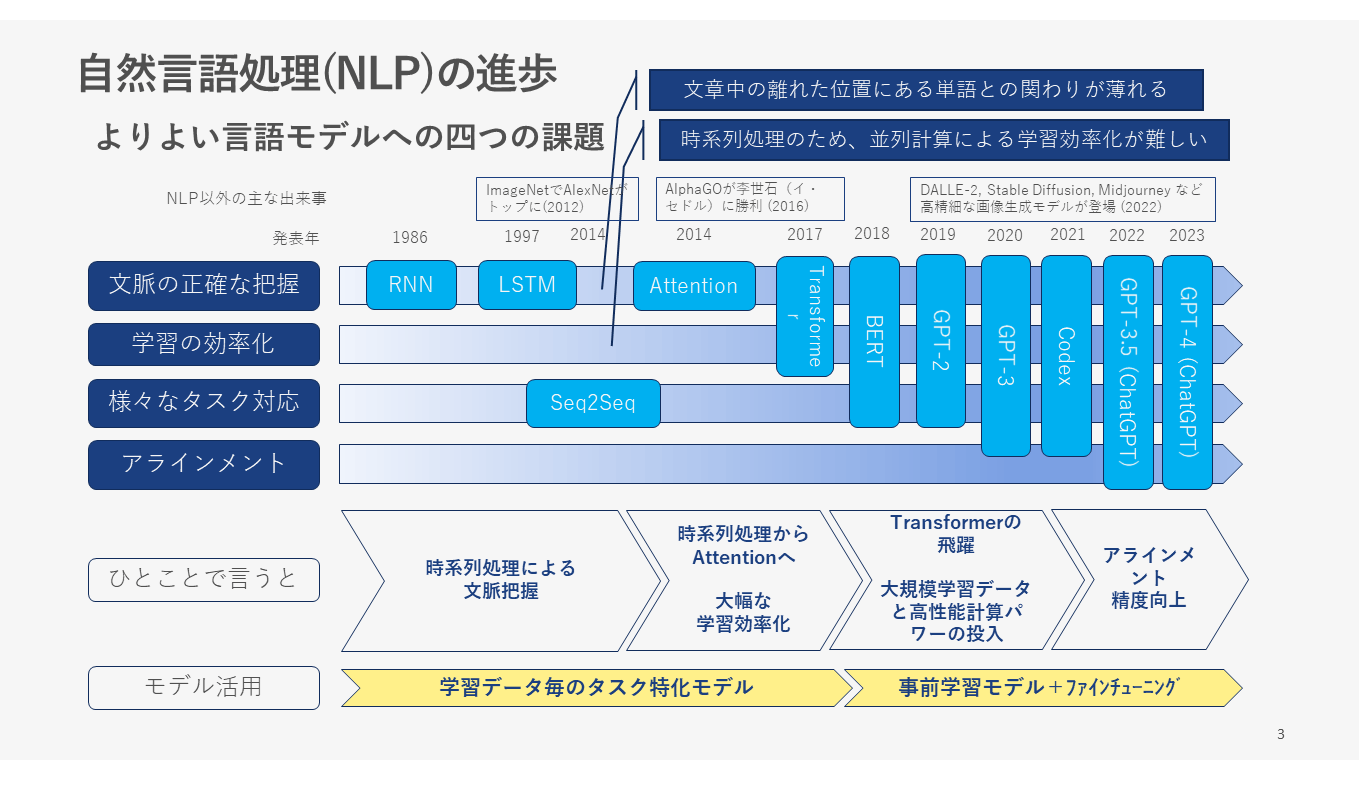

1.ChatGPTが生まれた経緯

ChatGPTが生まれた経緯を知ることは活用を推進して行く上でも大切だと思います。ポイントは次の通りです。(尚、説明をする上で若干のAI技術専門用語を使用せざるを得なかったため、難しく感じる場合は本項目はスキップしていただいて問題ありません。)

- ChatGPTという人工知能は、一夜にして生まれたわけではありません。これは、何年もの時間をかけて科学者たちが膨大な研究と開発を積み重ねた結果です。

- 一つの大きな進歩は、「並列処理」の採用でした。これは、複数の情報を同時に処理するという方法で、これまでの「時系列処理」、つまり、情報を順番に処理していく方式から一変しました。この変化は、Transformerという技術を使うことで実現されました。

- 次に、自然言語処理(人間が使う言語をコンピュータが理解・生成する技術)の進歩に寄与したのは、「事前学習済みモデル」の利用です。これは、大量のテキストデータを学習した後、特定のタスクに対してさらに学習(これを「ファインチューニング」と言います)する方法で、これにより自然言語処理は大きく飛躍しました。

- さらに、GPT-3などの大規模なモデルが出現しました。これらのモデルは、そのサイズと精度がとても高く、人間が書いた文章と区別がつかないほど自然なテキストを生成することができるようになりました。

- しかし、モデルが大きくなると新たな問題も生じました。それが「アラインメント問題」というもので、これはモデルが人間の意図を適切に理解・反映することが難しいという問題です。

- このアラインメント問題を解決するために、人間による高精度の回答を準備し、強化学習(モデルの振る舞いを改善するための学習方法)によるファインチューニングが行われました。そして、これらの取り組みの結果、ChatGPTが誕生したのです。

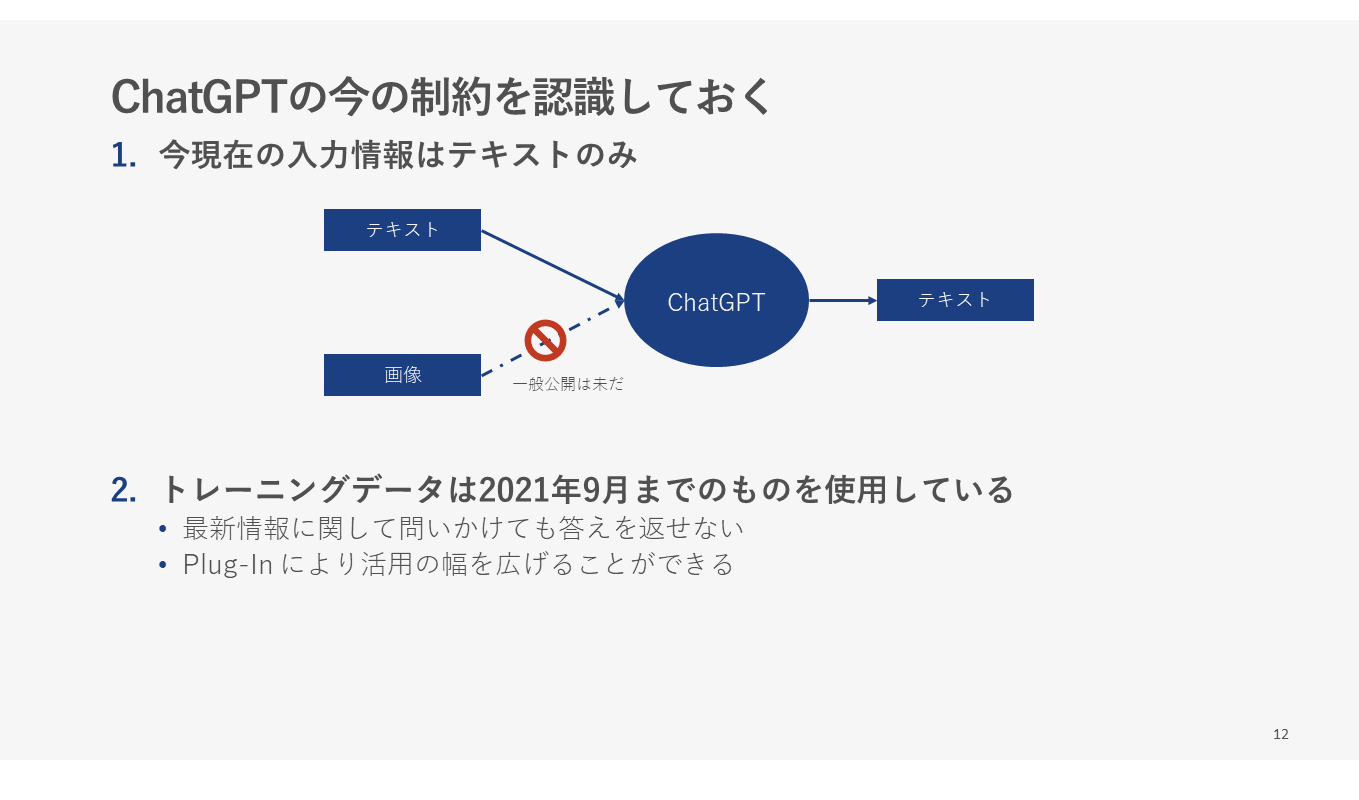

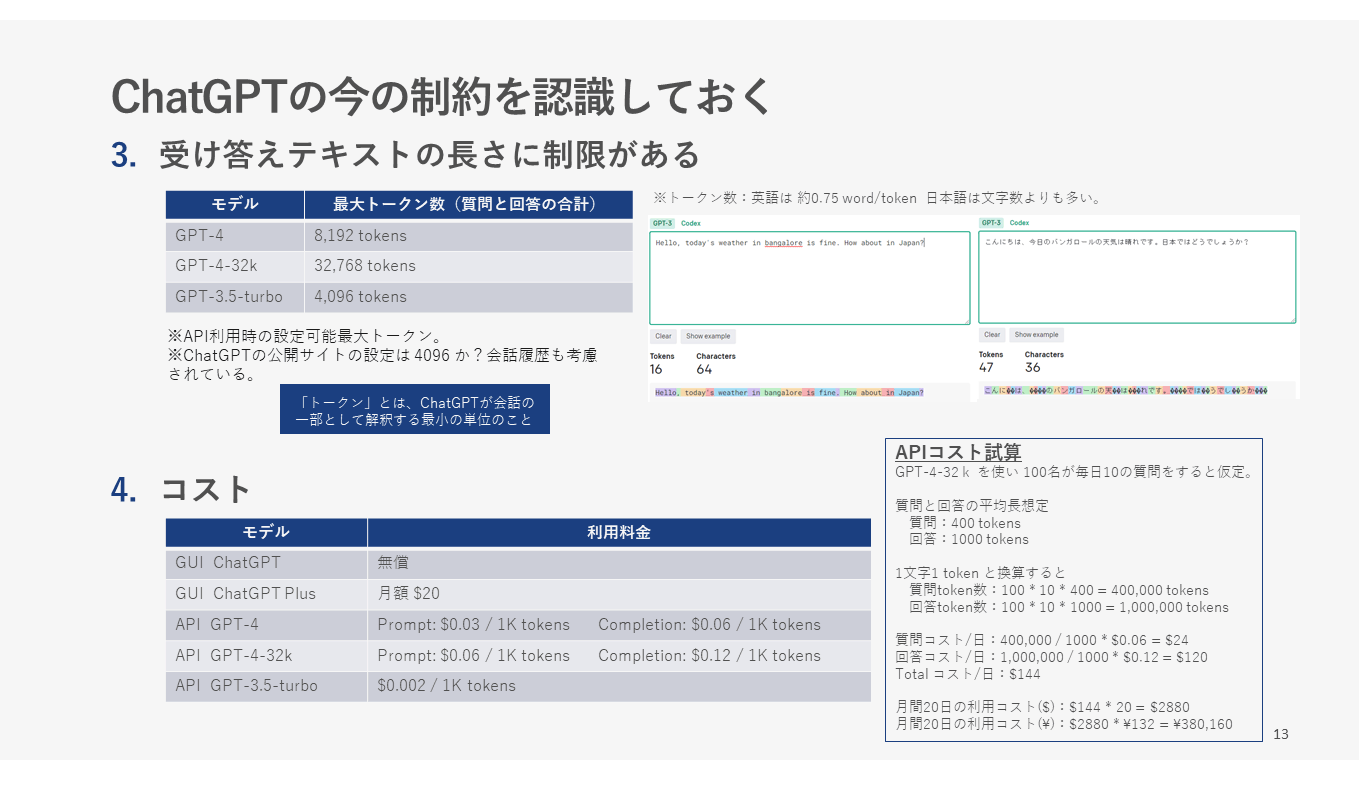

2.ChatGPTの業務活用への前提知識

ChatGPTは簡単に利用を始められますが、業務活用に向けては制約などを事前に知っておく必要があります。ポイントは次の通りです。

- ChatGPTという人工知能は、ユーザーからの入力情報として現時点ではテキスト(つまり、言葉)のみを受け付けています。GPT-4という新しいバージョンでは画像も入力できるようになりましたが、まだ一般には公開されていません。

- この人工知能は、2021年9月までに存在した情報を学んでいます。そのため、それ以降に起きた出来事や新しい情報については、うまく答えることができません。

- ただし、「プラグイン」という機能を使うと、最新の情報にアクセスしながら、ChatGPTの能力を活用することが可能になります。

- ChatGPTと話す際には、会話の長さに制限があります。そして、その制限はChatGPTがどのバージョン(たとえば、一般向けの公開版や開発者向けのAPI版など)であるかによって異なります。

- また、この人工知能を利用するには、無償版の公開版以外では一定の費用が必要です。たとえば、「ChatGPT Plus」というバージョンは月額20ドルで、APIという形で利用する場合は、トークンという単位によって課金されます。

- ここで「トークン」とは、ChatGPTが会話の一部として解釈する最小の単位のことで、文字数に近いものです。そして、英語と日本語を比べると、日本語の方が一つの発言に対して多くのトークンが必要とされます。これは、日本語の文字構造が英語より複雑であるためです。

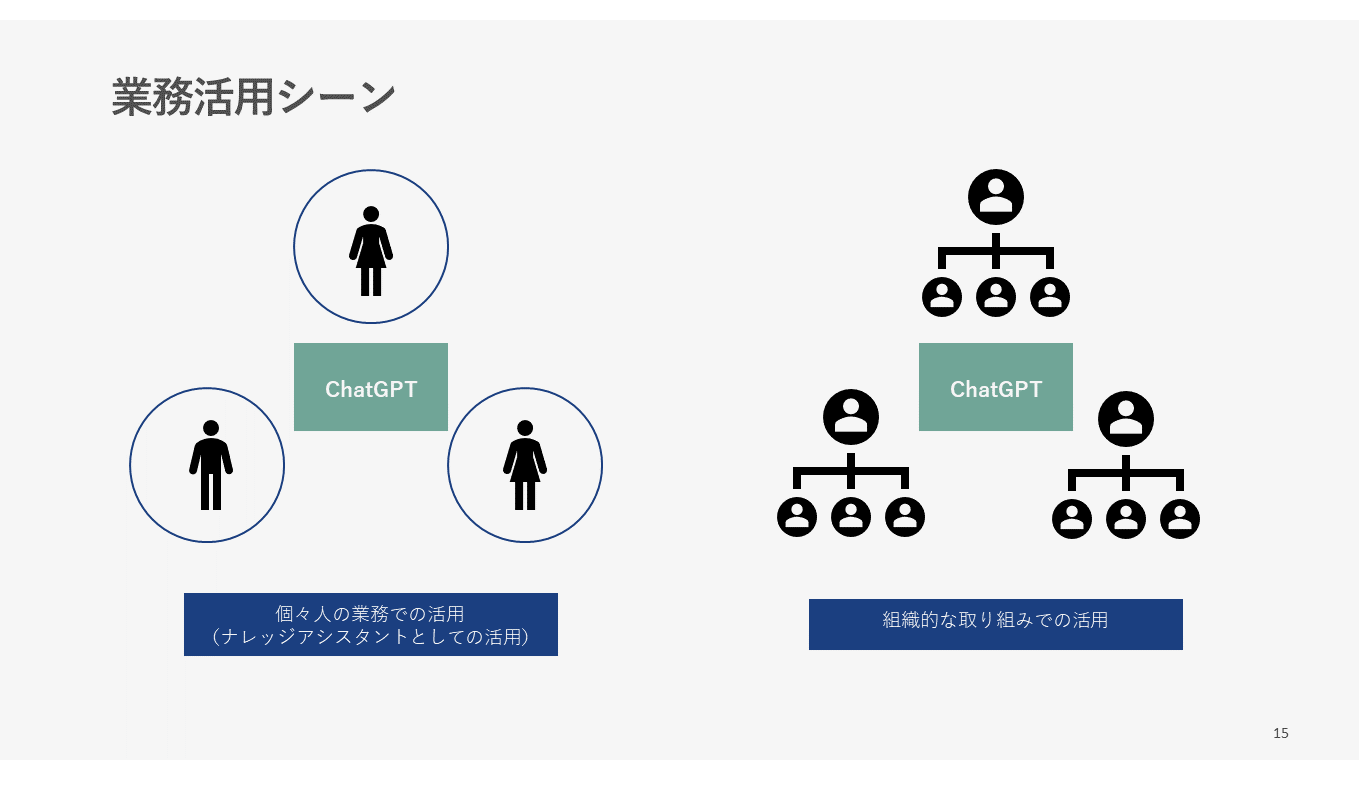

3.業務活用シーンと活用例

まず、人工知能(AI)の「ChatGPT」やその上位版の「ChatGPT Plus」をビジネスで活用する際に、2つの考え方があります。

- 一つ目は、社員一人ひとりが、ChatGPTを自分の仕事の助けとして使う方法です。これは、それぞれの社員がChatGPTのユーザーインターフェース(つまり、人とコンピュータが互いに情報を交換するための画面や機能)を利用し、個々の業務を円滑に進めるためのアシスタントとして活用する考え方です。

- もう一つの考え方は、組織全体で取り組む方法です。これは、組織全体が直面している問題を解決するために、ChatGPTのAPI(プログラムが別のプログラムとやりとりするための接続点や方法)を使って新しいアプリケーションを開発したり、「プラグイン」(既存のソフトウェアに機能を追加するためのモジュール)を開発することが必要になります。

これらの考え方を選択する際には、その企業や組織のニーズ、リソース、戦略などを考慮する必要があります。

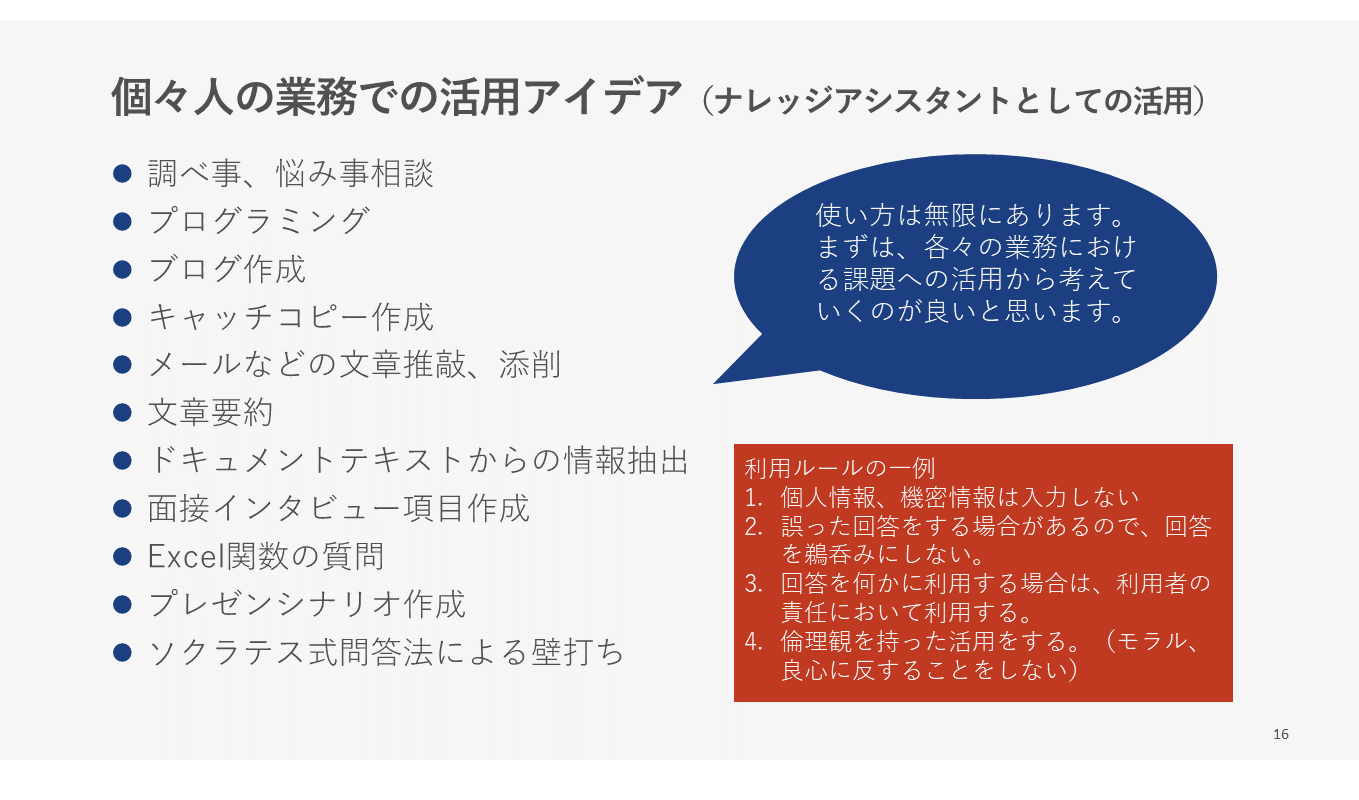

ここでは、個々人の業務での活用アイデアのきっかけとなるようなアイデアを紹介しています。また、人工知能(AI)である「ChatGPT」を仕事で活用する際には、以下のような基本的なルールや原則を心掛けることが大切です。これらのルールは、AIを上手に、そして適切に使うための指針となります。

- まず、個人情報や機密情報をChatGPTに入力しないようにしましょう。AIは非常に賢いですが、それでも情報の保護やプライバシーに関しては、ユーザー自身が十分に注意を払う必要があります。

- また、ChatGPTが提供する回答は常に正確とは限りません。したがって、その回答を無批判に受け入れるのではなく、自分自身で考え、確認することが大切です。

- そして、ChatGPTから得た情報を何かに利用する場合は、それは利用者自身の責任となります。つまり、得られた情報が正確かどうかを確認し、その結果に対して自己責任を持つ必要があります。

- 最後に、倫理的な観点からもAIを使用する際には注意が必要です。モラルや良心に反する使い方をしないように心掛けましょう。AIは道具の一つであり、その使用方法はユーザーの倫理観に大きく依存します。

ここでは、組織全体での取り組みとして、ChatGPTをどのように活用できるかについてのアイデアを紹介します。ただし、このアイデアはあくまで私の個人的な視点から出てきたものなので、一例としてご覧ください。

重要なことは、各組織、各企業はそれぞれ異なる業務上の課題を抱えているという点です。ですから、このアイデアは一概に全ての組織に当てはまるわけではありません。

なので、みなさん自身が直面している業務上の課題に焦点を当て、その課題解決のためにどのようにChatGPTを活用できるかを考えてみてください。私の提案がその一助となれば幸いです。

4.活用のリスク

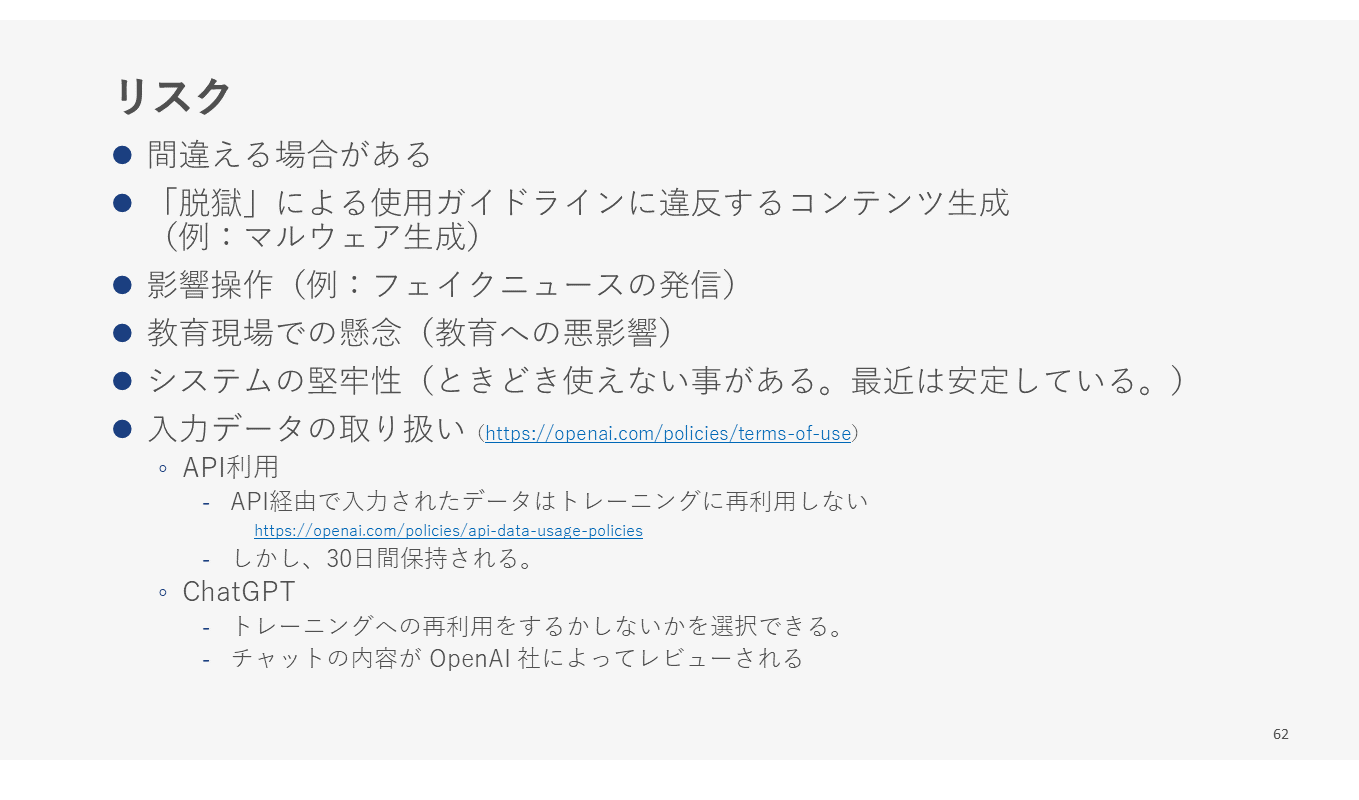

ChatGPTという人工知能を活用するときには、いくつかのリスクがあります。そして、これらのリスクを軽減または避けるための対策を考えることが重要です。以下に、具体的なリスクとそれぞれの簡単な説明を挙げてみましょう。

- 「誤った回答」: これはChatGPTが間違った情報を提供する可能性を指しています。人工知能は完璧ではなく、情報の誤解や間違いを起こすことがあります。

- 「"脱獄"による悪質なコンテンツ生成」: "脱獄"という表現は、AIが制約やガイドラインを越えて予期しないまたは不適切な結果を生成することを指します。

- 「影響操作を目的とした生成」: これは、ChatGPTがユーザーの意見や行動を不適切に操作しようとする情報を生成する可能性を指します。

- 「教育への悪影響」: これは、特に子供たちがChatGPTを教育ツールとして使用する際の広範な影響を指します。これには、誤った情報の学習だけでなく、AIに依存し過ぎることによる思考力の低下や、AIからの情報を批判的に考える能力の欠如なども含まれます。

- 「入力データの漏洩」: これは、ユーザーがChatGPTに入力した情報が外部に漏れるリスクを指します。

これらのリスクを理解し、適切な対策を講じることで、人工知能をより安全かつ効果的に活用することができます。

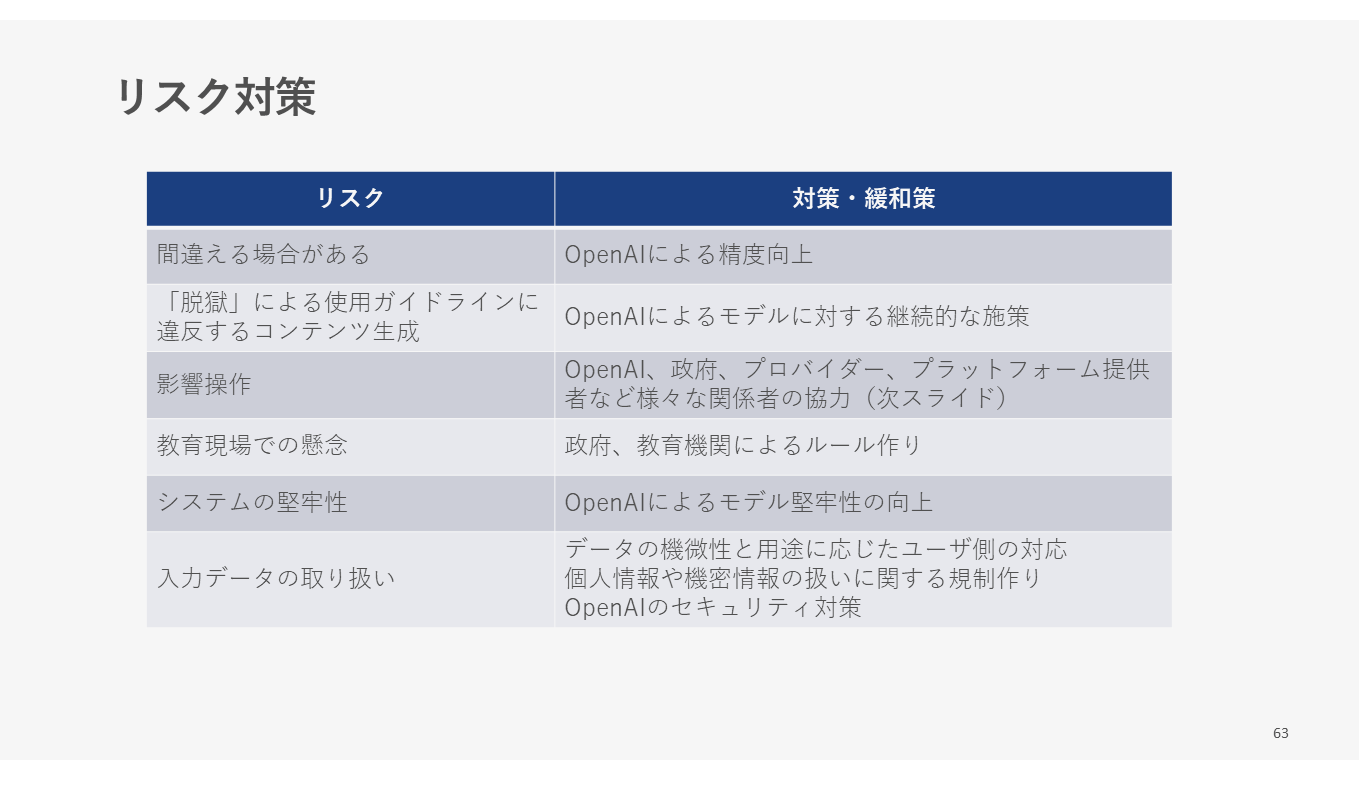

そして対策としてまとめたのがこのスライドです。このスライドでは、私たちがChatGPTを安全に利用するための対策について議論しています。ポイントは以下の通りです。

- 「開発者と社会両方の対策が必要」: これは、安全なAIの利用は、ただ作る人だけが対策を講じれば良いというものではなく、社会全体で対策を考えるべきという意味です。例えば、法律や規制、教育改善などが含まれます。

- 「誤った回答やデータの取り扱いは改善できる」: これは、AIの開発者がさらに工夫を凝らすことで、AIが間違った回答を出すことを減らしたり、ユーザーのデータを適切に保護したりすることが可能という意味です。

- 「ユーザーの入力データの学習利用は選択できる」: これは、あなたがChatGPTに入力した情報が、AIが更に学ぶための情報として使われるかどうかを、あなた自身が選択できるという意味です。APIを経由する場合は更に学習するための情報として使用しないとされています。

- 「影響操作や教育への悪影響には社会全体の取り組みが必要」: これは、AIが誤った情報を広めたり、特定の意見を押し付けたり、子供たちの教育に悪影響を及ぼしたりする可能性については、ただ技術的に対策を講じるだけではなく、社会全体で取り組むべきという意味です。

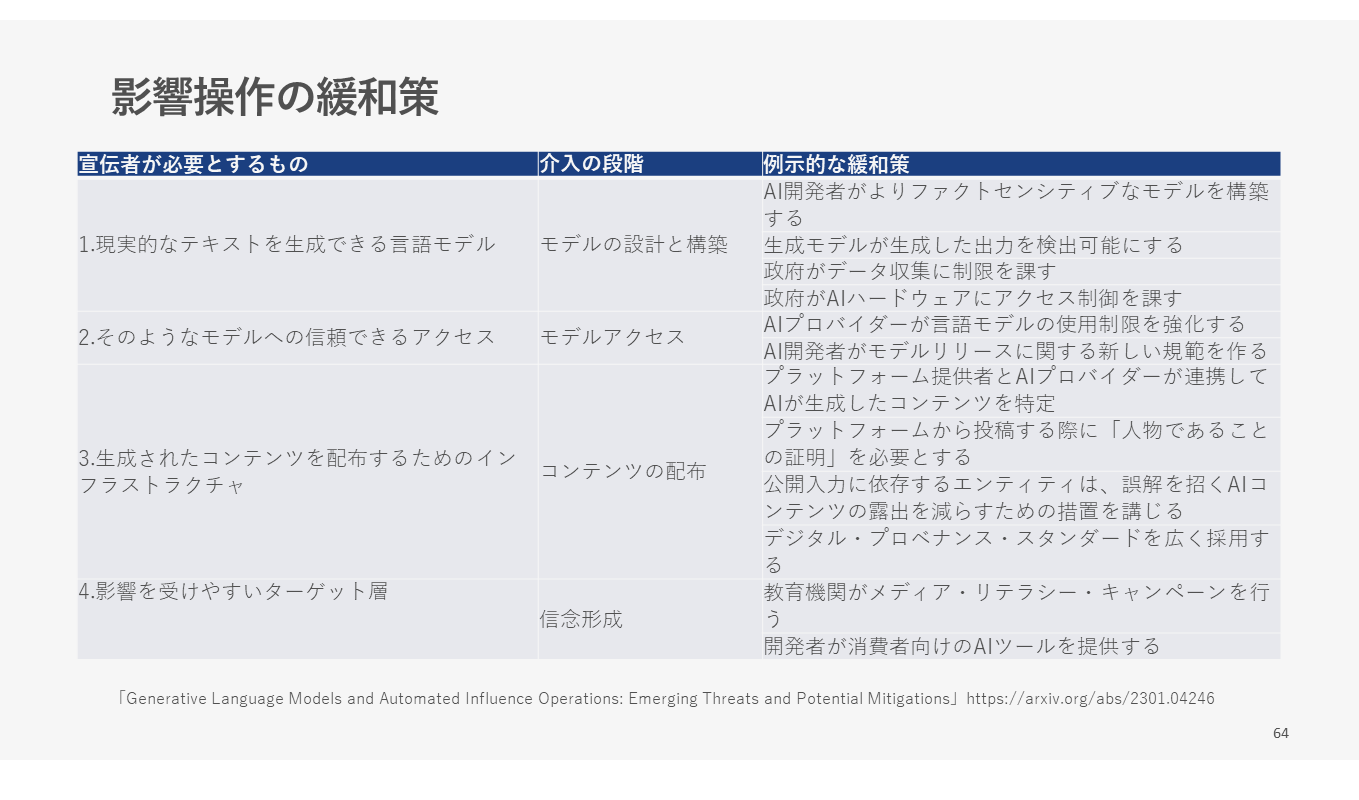

特に影響操作の緩和策としては、2021年10月に行われた扇動やフェイクニュースなどの影響操作を緩和するためのワークショップの内容を論文にしたものの中から、緩和策についてまとめたものをスライドにしています。このスライドのように、影響操作についての特効薬は今のところなく、今後対策が必要な重要な課題だと思います。

以上が、本資料のポイント、および説明時のポイントになります。資料では、具体的なアウトプットも交えてご紹介しています。社内説明時の参考になれば幸いです。

佐々木 宏