【GTC 2020】NVIDIA CEO Jensen Huang(ジェンスン・ファン)氏による、GPU テクノロジー カンファレンス異例のキッチン基調講演レポート!

今年も、AI、ディープラーニング、IoTやロボット、自動運転分野などにおける世界最大級のイベントであるGPUテクノロジーカンファレンス(GTC)の季節となりました。例年であれば、アメリカカリフォルニア州で大々的に開催されるカンファレンス。AIやディープラーニング技術、また、クラウドやエンタープライズコンピューティングなど周辺技術の未来について、その道のエキスパートや有識者たちがディスカッションを行い、関連企業やパートナーがこぞって各自の最新技術を展示する年に一度の一大イベントです。今年は、残念ながらまだまだ新型コロナウイルスの感染拡大が終息しないサンタクララ。GTCの基調講演も世相を反映しH2H(Home2Home)の形で日本時間2020年5月14日午後10時、YouTube上でCEOの自宅キッチンから映像配信されました。

開発者向けカンファレンスであるGTCは、GPUをはじめとするさまざまな最新技術セッション、最近注目のAIセッションなどが多数用意されています。H2Hとなった今年もNVIDIA CEO Jensen Huang(ジェンスン・ファン)氏の基調講演のほかにも、数多くのセッションが公開されました。

そこで、今回CEOの基調講演のなかからマクニカが注目する最新のテクノロジーを3つピックアップして紹介いたします。

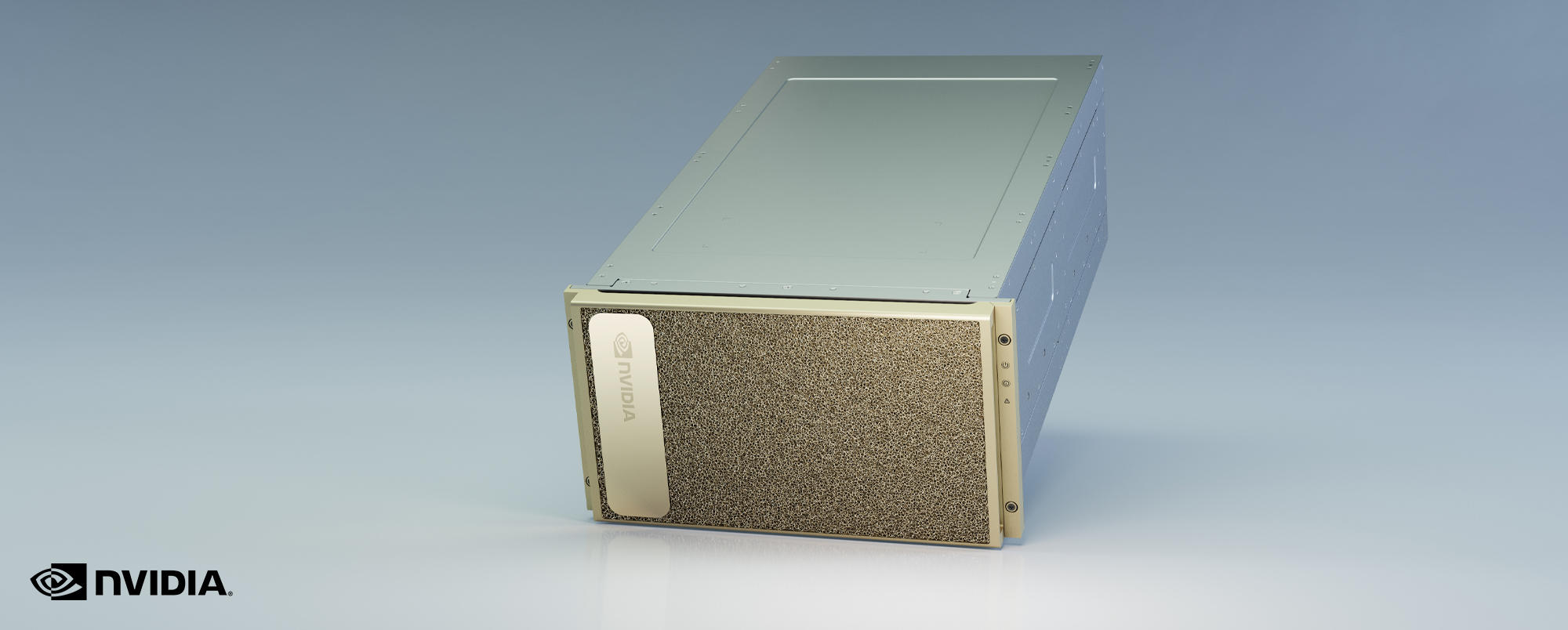

➀ 新Ampereアーキテクチャーを採用したGPU「NVIDIA A100」

Voltaの後継となる新Ampereアーキテクチャーを初採用したGPU「NVIDIA A100」。

2017年にVoltaと呼ばれるGPUアーキテクチャーを発表し、それをベースにするデータセンター向けのGPU「Tesla V100」を販売開始しました。「Tesla V100」は、CUDAコア並列演算用の演算器に加えて、Tensorコアと呼ばれるAIに特化した演算器を加えることで、AIの学習/推論時に高い演算性能を実現していました。

今回発表されたAmpereアーキテクチャーのA100は、新Tensorコアを採用しており、「TF32」と呼ばれる、FP32とFP16のハイブリッド方式でFP32演算を行える仕組みを採用、これによりソフトウェアを修正することなく、演算時の性能を大きく向上させました。

A100はTSMCの7nmプロセスを使用するGPUで、前世代となるVoltaの2倍以上となる540億のトランジスターを実装、ハイブリッド演算により、FP32(単精度の浮動小数点数)演算時は312TFLOPS(テラフロップス)を実現し、演算性能は従来品と比較し20倍に向上しています。

また、A100を搭載したAI学習向けのサーバー「NVIDIA DGX A100」(以下、DGX A100)も発表。DGX-1(Tesla V100を8基搭載)、DGX-2(Tesla V100を16基搭載)に続くDGXシリーズの最新製品となります。A100の採用によりデータセンターのあらゆるユースケースに適用できるアーキテクチャー(MIG:Multi-Instance GPU)が実装され、幅広い用途への活用が期待されます。

新「NVIDIA DGX A100」モデルの特徴

- 新GPU「A100」を8基搭載

- AIの学習や推論においてVolta世代の従来GPUに比べて約20倍の性能を実現

- GPU間をつなぐNVSwitchを6個採用

- Mellanoxのネットワークカード製品「ConnectX-6 VPI」を9枚搭載

- CPUには、米AMDの「第2世代EPYC」(開発コード名:「Rome」)を採用

② NVIDIA x Mellanox 次世代データセンターの構築モデル

140台のDGX A100システムと170台のMellanox Quantum InfiniBandスイッチを組み合わせた、次世代の「DGX SuperPOD」の構築構想も発表されました。強大なAIコンピューティング性能をもつクラスターにも関わらず、3週間で構築可能になっているといいます。

さらに、NVIDIAはデータセンターのショーケースとして「NVIDIA DGX SATURNV」を拡張。1800台のDGXシステムに加えて、3つのDGX A100 SUPERPOD(560台のDGX A100)を追加、さらなる処理能力を追加することを発表しました。

③ EGX エッジAIプラットフォーム

来たる5G時代に向け、IoTデバイスによって収集される膨大なデータの分析や解析に、ネットワーク負荷の軽減と低遅延かつセキュアな処理を実現するためのエッジAIの実用化は、企業の喫緊の課題であることは周知の事実です。

EGX A100 は、Ampere アーキテクチャーをベースにした、初のエッジ AI向けの製品で、サーバーに EGX A100 を搭載することで、エッジセンサーからストリーミングされる大容量データをリアルタイムで処理および保護できるようになります。

EGX A100 では、圧倒的な性能に加え、 NVIDIA Mellanox® ConnectX-6 Dx SmartNIC の優れたネットワーキングおよびセキュリティ機能が組み合わされています。NVIDIA Mellanox のタイムトリガー型伝送テクノロジー (5G 向け 5T) の登場により、大容量のデータをリアルタイムに処理、標準的なサーバーがAI処理できるスーパーコンピューターにすることができます。

例えば、空港や駅のような公共施設で数百台のカメラを「EGX A100」搭載のエッジサーバーで管理、といった用途も想定されています。

基調講演では上記のほかにも、リアルなイルミネーションやシャドウ、鮮やかな色彩を表現するレイトレーシング技術を駆使したデモによる次世代NVIDIA RTX、マルチモーダルな次世代会話型AIロボットのフレームワークであるNVIDIA Jarvis、AIを体現するMistyデモ、自律走行車開発に関する最新情報も紹介されました。

基調講演を見る場合はこちら

part1

part2

part3

part4

part5

part6

part7

part8

part9

最後に

毎年の恒例となったGTCでは、NVIDIA社の最新の技術やGPUの現状や今後のロードマップなど多種多様な情報に触れることができます。

今回のGTCキッチン基調講演を視聴し、さらにパワフルなAI学習環境を可能にするサーバーの提供、また、コンパクトなエッジAIプラットフォーム環境が可能になったことで、AIをビジネスに活用できる導入間口が格段に広がったのではないかと感じました。NVIDIAがこれからどこに向かうのか、AIを使ってどんな世界を提供してくれるのか本当に楽しみです!