DeepKeep

ディープキープ

AI/LLMを守る ~AI-ネイティブ Security & Trustプラットフォーム~

DeepKeepのAIネイティブ Security & Trustプラットフォームは、AI、LLM、コンピュータービジョンモデルに関するセキュリティリスクや推論の信頼性の課題を包括的に解消します。

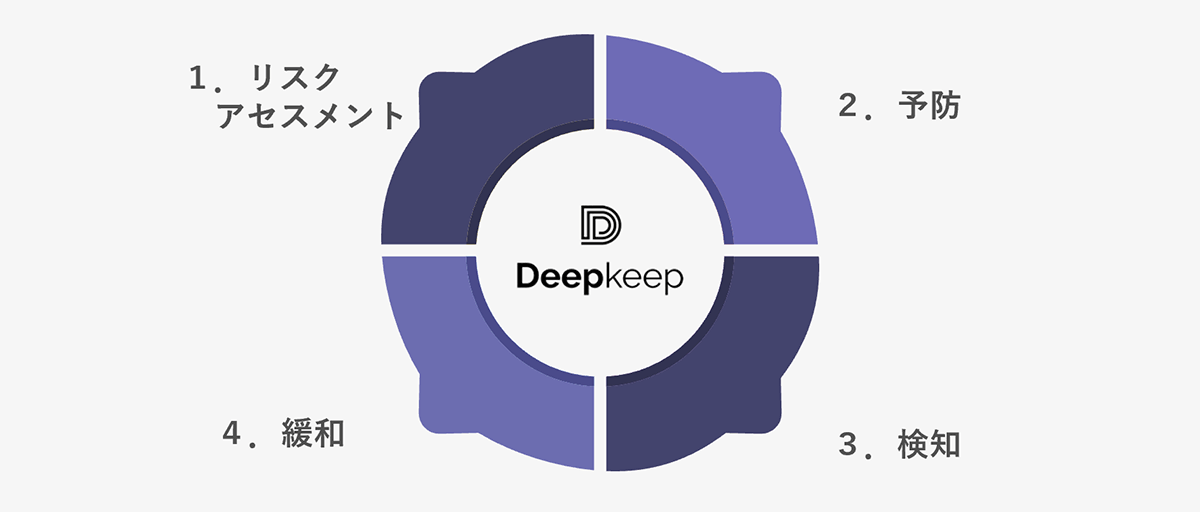

AIを安全・安心に使うための4つの機能

1.リスクアセスメント

自動化されたペネトレーションテストの実施

- モデル・データをアップロードし、検査項目を指定するだけの簡単設定

- 脆弱性の評価

- ポイズニングとバックドアの検出

- 発見した課題に対して、優先順位を付けて、推奨事項の提示

2.予防

課題に対するセキュリティ強化策の提示

- 発見した課題に対処するための前処理・後処理

- AIモデルの修復提案

3.検知

モデル性能を損なわない検知ソリューション

- リアルタイムの検知

- 事後の検知

- 異常値などの検出

4.緩和

AIファイアウォールによる緩和策の提供

- 検知時のアクセス制限

- リアルタイムのアラート発報

- セキュリティオペレーションセンターとの連携

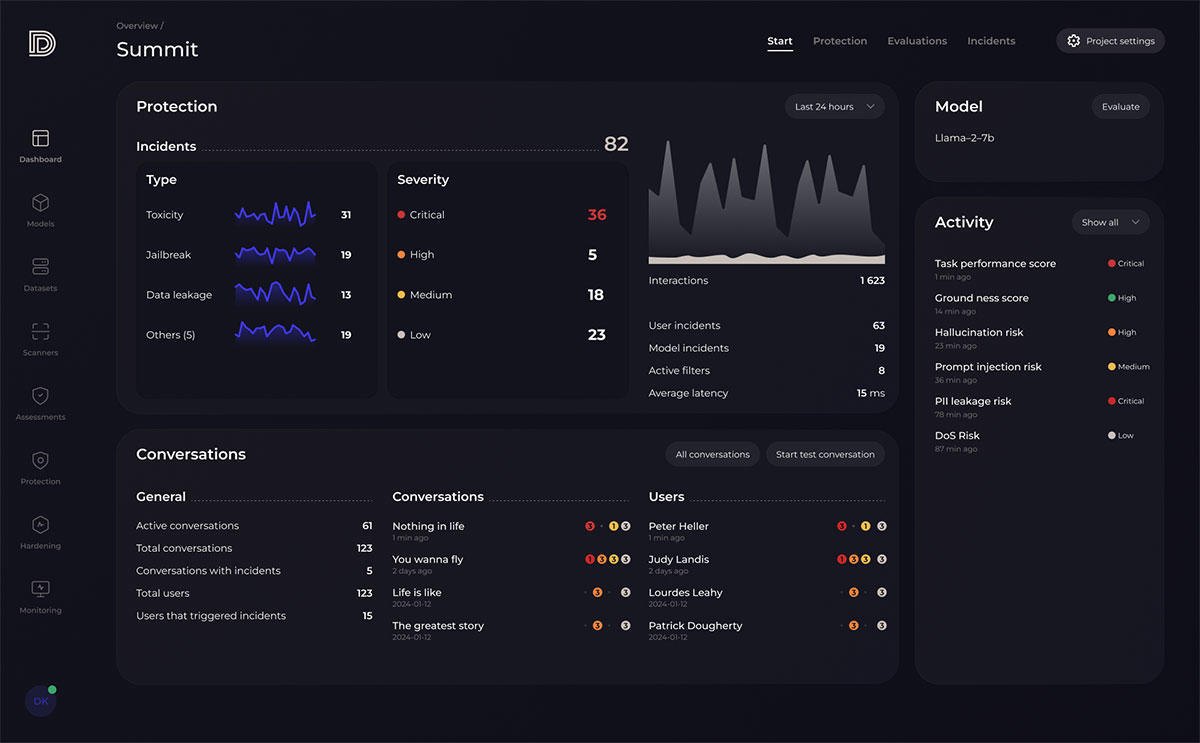

プラットフォーム

AIモデルに対する各種リスクを特定し軽減するための一連のツールを提供します。

- アセスメント、予防、検知およびその緩和を一つのプラットフォームで確認可能

- 本番環境で実行されているモデルの可視化や高レベルな説明可能なAIを提供

- 個々のモデルからパイプラインに至るまで、AIモデルの導入ライフサイクル全体をカバー

<DeepKeepのダッシュボードサンプル>

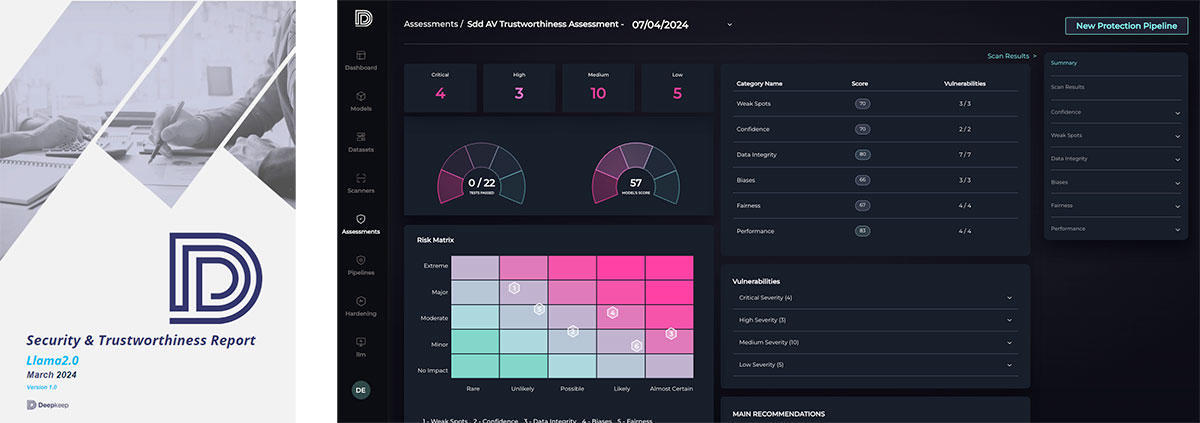

診断サービス

モデルと学習データに対する各種アセスメントを提供します。

- 画像をはじめさまざまなデータフォーマットを用いるAIモデルのアセスメントに対応

- AIのトラスト※1、セキュリティ※2の両面からAIモデルの診断を行い、詳細なリスクレポートとして提供

※1 トラスト:信頼性、バイアス、ドリフト、公平性など

※2セキュリティ:バックドア、ポイズニング、回避攻撃、モデル窃盗など

業態別ユースケース

- 金融:リスク管理や不正検出

- 保険:保険金請求の自動処理におけるセキュリティを強化

- セキュリティ:サイバー攻撃からの保護を強化

- 自動車:自動運転車の安全性を確保

- AIコンピューティング:大規模なAIモデルの運用におけるリスク管理

オンデマンド動画

会社説明

| 会社名 | DeepKeep Ltd. |

|---|---|

| 設立 | 2022 |

| 所在地 | Israel |

| 代表者 | Rony Ohayon |

| ウェブサイト | https://www.deepkeep.ai/ |

お問い合わせ・資料請求

株式会社マクニカ DeepKeep 担当

- TEL:045-476-2010

- E-mail:deepkeep-biz@macnica.co.jp

平日 9:00~17:00