こんな方におすすめの記事です

データサイエンティスト、機械学習エンジニア、人工知能について勉強をしている全ての人

この記事を読み終えるのに必要な時間

10分

はじめに

本コラムはNeurIPS 2019の参加レポートです。

2019年12月8日~14日にカナダ・バンクーバーで開催されたNeurIPS 2019に、マクニカのAI Research & Innovation Hub(ARIH)のメンバーが参加してきました。

第一回目のレポートでは、

・数あるAI学会の中でNeurIPSの位置づけは?

・投稿論文から見たAI技術トレンドは?

をお伝えしました。(まだご覧になっていない方は是非こちらからご覧ください!)

第二回目のレポートでは、

・実際のセッションから見たAI技術トレンド

・ARIHが興味を持ったAI Keyword5選

をお伝えします。

NeurIPS 2019 セッションから見た今年のAI技術トレンド

NeurIPSはPosters、Workshopなどで構成されているのですが、各セッションで変化が見られました。

まず、Workshopの中身を一部ご紹介します。

Workshop

単なる理論の研究から、公衆衛生、気候変動や自然災害、犯罪予測などの社会課題や金融サービス、オンラインマーケティングなどに対する機械学習の実用化に向けた研究に本格的に移行しており、その中でも課題となっているプライバシーや公平性などに対する研究が盛んである印象を持ちました。

ヘルスケア

ヘルスケアにおける公正な機械学習、気候変動に取り組む機械学習が注目を集めていました。

特にヘルスケアでは、公衆衛生におけるソーシャルワーカーのリソースが限定されており、そのリソースを最適化するために機械学習が応用され公平性を保てるようにしています。

インドでは結核患者に対してデータを活用した機械学習により、薬を適切に飲んでいるか確認し、飲み忘れの患者がいる場合にはアラートを投げて命をつないだという事例を取り上げていました。

また、機械学習モデルが持つバイアスにも触れており、人種による健康リスク判断についても発表がありました。

プライバシー

プライバシー問題については、個人情報を使って作ったモデルを、個人の要求により削除して欲しいという依頼が来た場合に削除する必要があります。

その場合、モデルの精度に影響を及ぼすため、すべてのデータを再学習する必要があります。

しかし計算リソースを加味すると現実的ではなく、オンライン学習を活用した手法が提示されていました。

ヒューマンインザループ(HIL)

NeurIPSではDiversity and inclusion委員会を設立し、多様性や障害者の参加にも力を入れています。

Women in Machine Learning、Black in AI、Queer in AI、LatinX in AI、{Dis} Ability in AIなどが開催されていました。

各団体は機械学習において活躍の幅を広げることを目的に活動しています。

このような活動がより活発化していくことにより、社会的により活躍したい個人とよりリソースを確保したい企業のニーズが合致し、ますます社会的に発展&貢献できる世界が広がることが期待されます。

NeurIPS 2019マクニカが興味を持ったAI Keyword 5選

1. XAI(Explainable AI)

特にディープラーニングなどのニューラルネットワークモデルの中身は、基本的に解釈が難しいです。

よって、中身はブラックボックスと扱われることが多いです。

しかし、先にも述べたように実社会への適用を進める場合、中身が説明できないモデルでは安心して活用できないという問題が発生します。

例えば医療において、何らかの疾患があると機械学習が判断した場合、説明可能なAIでないと「なぜそのような判断をしたか」原因を追究できないという問題が発生します。

このようなことが実社会で機械学習を応用する場合のリスクと考えられています。

そのためブラックボックスモデルの解釈性を得るための研究が盛んであり、本学会にもいくつかの論文が発表されていました。

製造業のお客様がAIの説明性に強い興味を持っていらっしゃるので、我々としてもその動向に着目しています。

【ピックアップ論文5選】

・A Benchmark for Interpretability Methods in Deep Neural Networks

・CXPlain: Causal Explanations for Model Interpretation under Uncertainty

・Deliberative Explanations: visualizing network insecurities

・Explanations can be manipulated and geometry is to blame

・Fooling Neural Network Interpretations via Adversarial Model Manipulation

2. Bayesian Deep Learning

ベイズではパラメータそのものが、ある確率分布に従う確率変数であると考えます。

つまり、得られたデータからモデルに重要なパラメータを推測することになります。

ディープラーニングでは、不確かさをモデル化することは困難であり、その不確かさを理解するためにモデル化する手法がBayesian Deep Learning(BDL)です。

Workshop(http://bayesiandeeplearning.org/)も開催されており今後、ますます盛り上がりそうな分野のため、注目していきたいと思います。

【ピックアップ論文5選】

・Practical Deep Learning with Bayesian Principles

・Gaussian Process Behaviour in Wide Deep Neural Networks

・On estimating epistemic uncertainty

・Using Loss Surface Geometry for Scalable Bayesian Deep Learning

・Uncertainty under distributional shift

3. Few-shot or Zero-shot Learning

少ないデータでいかに上手に学習させるかも一つのトレンドとなっています。

Few-shotやZero-shot以外にもOne-shotなどがありました。

本質的には良質なデータを取得して蓄積し、定期的に再学習して機械学習モデルをメンテナンスすることが重要ですが、どうしてもデータが集められないケースは現実的にあると思いますので、このような研究も興味深いです。

【ピックアップ論文5選】

・Zero-shot Learning via Simultaneous Generating and Learning

・Zero-Shot Semantic Segmentation

・Cross Attention Network for Few-shot Classification

・Adaptive Cross-Modal Few-shot Learning

・Few-shot Video-to-Video Synthesis

4. Federated Learning

分散したデータを用いて共通のモデルをアップデートする仕組みです。

学習はエッジデバイス側で行い、クラウド上の共通モデルに差分を反映するので、クラウドへデータを上げたくない場合でも対応できます。

またエッジ環境に適したモデルを作ることができ、かつ共通のモデルをチューニングすることが可能となります。

さらにプライバシー保護にもつながります。

上り回線が遅いという現実的な環境に合うように、更新部分を圧縮する技術や暗号化する技術も同時に開発しているようです。

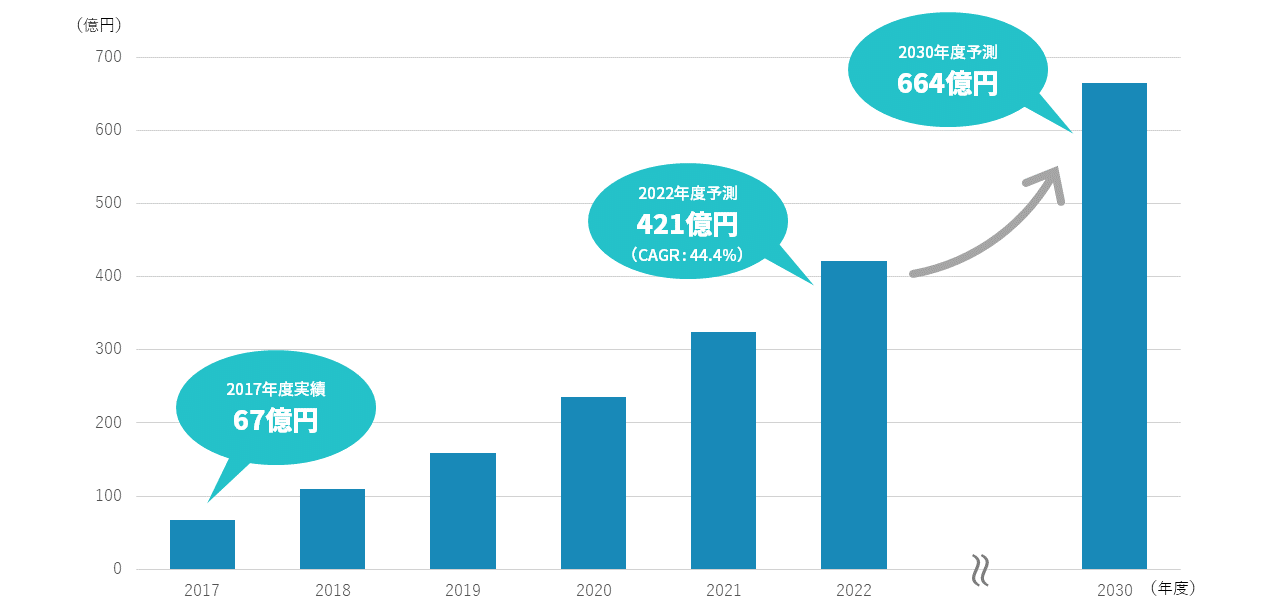

エッジコンピューティング市場は今後伸びていくと予測されていますので、このような技術との親和性が高まるとユーザーの利便性がますます向上しそうです。

出典:株式会社富士キメラ総研「2019 人工知能ビジネス総調査」 p.6 2.エッジコンピューティング市場規模 を元にマクニカが作成

5. Privacy Protection

機械学習が社会実証される段階に入ると、学習に利用されるデータの扱いに焦点が当てられます。

特に個人情報の扱いは非常にセンシティブであり、プライバシーを確保しながらいかに機械学習に適用するかについて、研究が盛んになってきています。

機械学習がもたらす恩恵を利用者が安心して受けることができる世界が望まれます。

【ピックアップ論文5選】

・Differentially Private Algorithms for Learning Mixtures of Separated Gaussians

・Locally Private Gaussian Estimation

・Differentially Private Bayesian Linear Regression

・Differentially Private Markov Chain Monte Carlo

・Differentially private anonymized histograms

まとめ

NeurIPS2019は、Slides Liveによりライブ配信されており、学会が終わった今でも、誰でも無料で視聴することができます。

https://slideslive.com/t/neurips-2019

また、採択された論文や関連ポスター一覧はこちらで確認することが可能です。

https://nips.cc/Conferences/2019/Schedule?type=Poster

2019年はNeurIPSをはじめ、ICMLやIJCAIなどのAI国際学会に参加しました。

AIの目覚ましい進歩と、研究の世界から実用の世界へ確実に向かっていることを肌で感じることができました。

ARIHとしてもこのAIの進化に少しでも貢献したいと考えており、2021年1月に開催予定のIJCAIではスポンサーとしてインダストリアルセッションに登壇いたします。是非ご参加ください。