こんな方におすすめの記事です

- AAAI 2019に採択された論文ってどんなものがあるのか知りたい方

- 論文を読む時間がないけれど、最近のAI研究について知りたい方

- AAAI 2019について知りたいという方

この記事を読み終えるのに必要な時間

10分未満

AAAI 2019の論文をPickupしてご紹介します

こんにちは、マクニカAI女子部のMakkyです!年々夏の期間が長引き、まだまだ気温の高い日が続きそうです。

ですが季節は秋にシフトし、徐々に寒くなってくるはずです。

季節の変わり目なので、皆様も体調に気を付けてお過ごしください!

さて早速ですが本題へ。今回のブログのテーマは、「AAAI 2019採択論文」です。

先日のテックブログでは CVPR 2019に採択された論文をご紹介いたしましたが、CVPRに引き続きAAAI 2019に採択された論文についてもご紹介したいと思います。

AAAI 2019の論文から近年のAIトレンドが伺えます

AAAIは毎年1月~2月に開催される、世界トップクラスの人工知能に関する国際カンファレンスです。

そのためAAAIに採択された論文を読むことによって、人工知能全般の最新動向を伺うことができます。

今回は2019年1月27日~2月1日に開催されたAAAI 2019の採択論文のうち、近年AI研究が活発な中国から発表された論文を3つピックアップしてご紹介いたします。

- マルチモーダル学習を用いた交通機関推奨手法 “ Joint Representation Learning for Multi-Modal Transportation Recommendation ”

- 高性能な顔認証用フレームワーク “ Selective Refinement Network for High Performance Face Detection ”

- 実運用でも性能を評価済みであるCTR予測のアーキテクチャ “ Deep Interest Evolution Network for Click-Through Rate Prediction ”

1. “ Joint Representation Learning for Multi-Modal Transportation Recommendation ”

ご紹介する1本目「Joint Representation Learning for Multi-Modal Transportation Recommendation」は、マルチモーダル学習による交通機関の推薦システムを提唱し、そのフレームワークを構築した論文です。

最近数々の研究がされており、ディープラーニングの1つトレンドでもある マルチモーダル学習。

マルチモーダルとは 複数のモダリティ(感覚)を利用 することを言い、機械学習におけるマルチモーダル学習は、複数種類のデータから学習して統合的に処理をする学習手法です。

さて、ご紹介する論文に出てくる交通機関推奨システムですが、従来は1つのモダリティにのみ焦点を当てて、徒歩、自転車、自動車、公共交通機関などのさまざまな移動手段や、それらを組み合わせた移動手段をユーザーにお勧めしていました。

しかし、交通機関の推奨にユーザーの好み(費用や時間など)や移動の特徴(移動目的や移動距離など) も考慮すれば、さらにユーザーに合わせた良い推奨ができると考えられます。

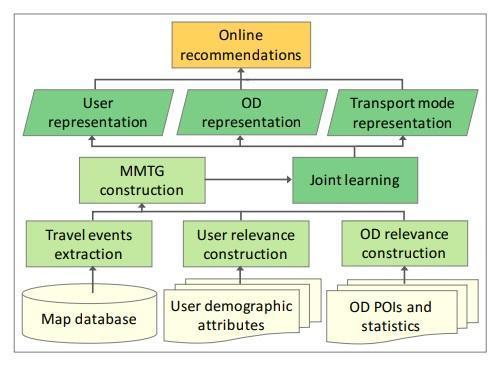

そこで本論文中では、マルチモーダル学習による交通推奨が可能な学習フレームワーク Trans2Vec を提案しています。以下の図はTrans2Vecフレームワークの概要図です。

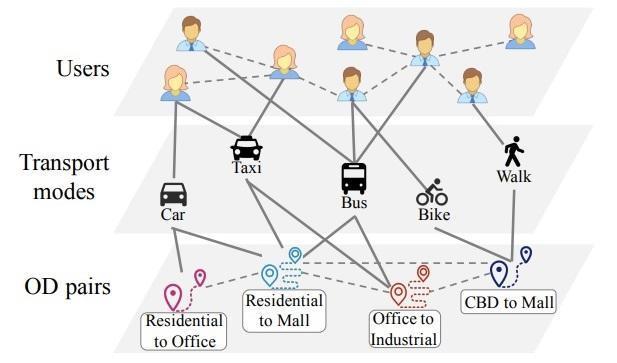

具体的には、地図データベース、ユーザーの人口統計属性、および出発点-到着点情報を含むデータに基づいて、下図のようなイメージで、複数のモダリティに焦点を当てたマルチモーダル交通グラフを作成します。

この交通グラフを用いて交通手段の学習をすることで、ユーザーと目的地の履歴から適宜最適な交通手段を取得できるようになっています。

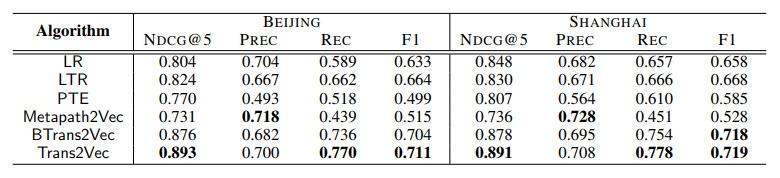

論文中では複数の推薦システムの評価指標を用いて、既存のアルゴリズムとTrans2Vecの性能比較もしています。その結果が以下の表になります。

北京と上海の交通機関推奨をした結果、PREC(Precision=適合率)以外の3つの指標で、Trans2Vecは良い値を出しています。

PRECにおいても値としてはさほど悪くない、むしろ1番に良い値とあまり変わらない値となっています。

Trans2Vecは既に実運用システムに導入もされており、今後も活躍するフレームワークとなりそうです。

2. “ Selective Refinement Network for High Performance Face Detection ”

続いては「顔認証」をテーマに論文をご紹介いたします。

最近日本の大手企業でも顔認証のキャッシュレス決済におけるシステム開発が活発で、ニュースでもシステム開発のアップデート情報をよく見るようになりました。

もちろん顔認証はキャッシュレス決済以外の用途としても利用できるため、日本に限らず多くの国で顔認証の研究は熱心に行われています。

そこで2本目は、顔認証研究がとても活発な中国の研究論文「Selective Refinement Network for High Performance Face Detection」です。

顔認識のタスクは以前から熱心に研究が行われていましたが、人混みの写真など、小さな顔が多く存在するような画像を対象にした顔認識は高性能とは言い切れず難しい課題でした。

従来の顔認識タスクにおける課題は2つあり、その課題の1つめは再現率。

2017年に提唱されたSOTAのReitiaNetでさえも、精度(適合率)は90%で再現率は50%と、適合率は良いですが再現率はあまり良くありませんでした。

そして課題の2つめは位置の認識精度における課題です。小さな顔になればなるほど、顔の位置特定は難しくなります。

今回ご紹介するこの論文では、新しい顔検出用フレームワークである Selective Refinement Network(SRN) を提唱しています。

SRNは選択的2段階分類(STC)と選択的2段階回帰(STR)という2つの主要なモジュールで構成され、この2つのモジュールによって偽陽性を減らすと同時に位置精度を改善しました。

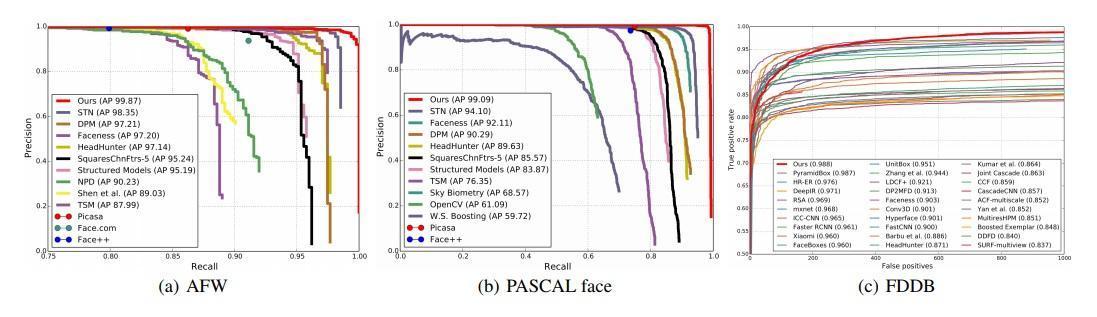

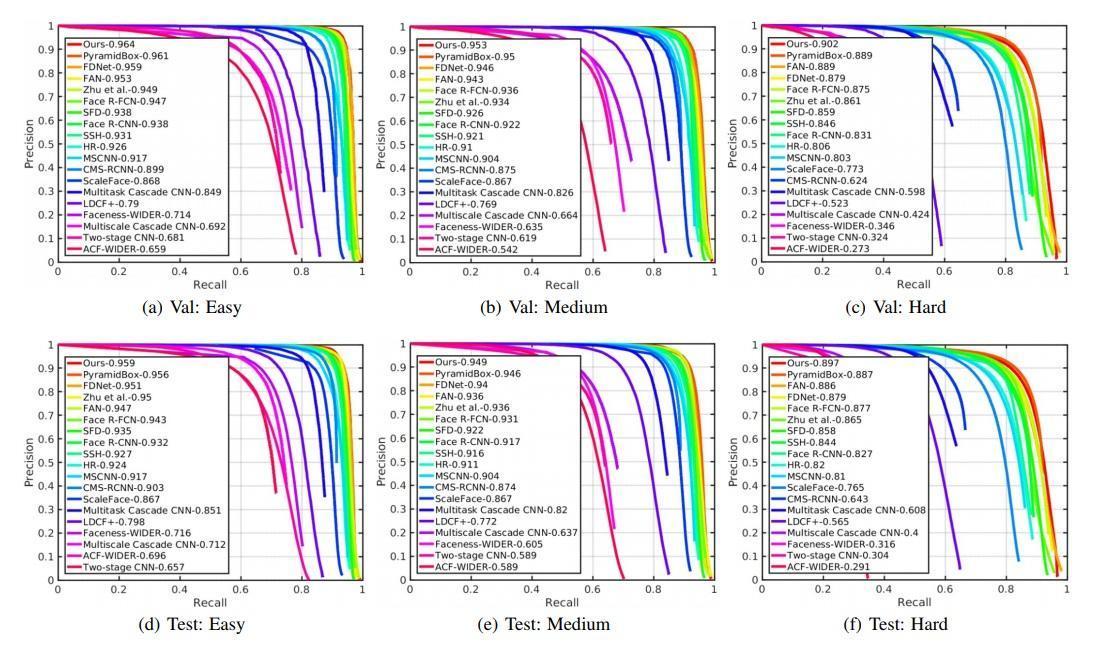

以下はAFW、PASCAL face、FDDBと言う顔認識用データセットを使用した顔認識の精度比較です。

赤線で示すOurs(つまりSRN)がどのグラフにおいても高精度であることがわかります。

そして、下図はWIDER FACEと言う顔認識用データセットを使用した顔認識の精度比較です。

こちらも同様に、どのデータセットケースにおいてもSRNが高精度であることがわかります。

顔認証は普段の生活でも身近な分野であるからこそ、今後さらに発展し、現在多くの企業で開発・研究中の顔認証キャッシュレス決済もクオリティの高いものになっていくかもしれません。

3. “ Deep Interest Evolution Network for Click-Through Rate Prediction ”

最後に、私が最近少し興味のあるマーケティング分野で既に活躍している技術のご紹介です。

マーケティング用語として、 LTV (生涯で一人の顧客が企業にもたらす利益の合計:Life Time Value)や CPA (1件の成果に対して、広告費用がいくらかかったかを表す数値:Cost Per Action)などがありますが、これらの数値と広告の関係性はとても密接です。

スマートデバイスの普及により、今や広告は身近すぎる存在ではありますが、ここ2年ほど市場規模ではWeb広告の方がテレビ広告を上回っています。

そこで3本目の論文は、Web広告業に関してのCTR(Click Through Rate=クリック単価)の予測をする研究をご紹介いたします。

CTR予測を行う手法として、これまでにDIN(Deep Interest Network)が考案されていました。

このDINでは、ターゲットアイテムへの相対的な興味はユーザーの動作と関連があると直接的にみなしていました。

しかし、ユーザーの潜在的な関心は、ユーザーの明示的な行動に完全に反映されるとは限りません。

また、ユーザーの関心は常に変化・進化するため、関心の動向を捉えることはとても重要になってきます。

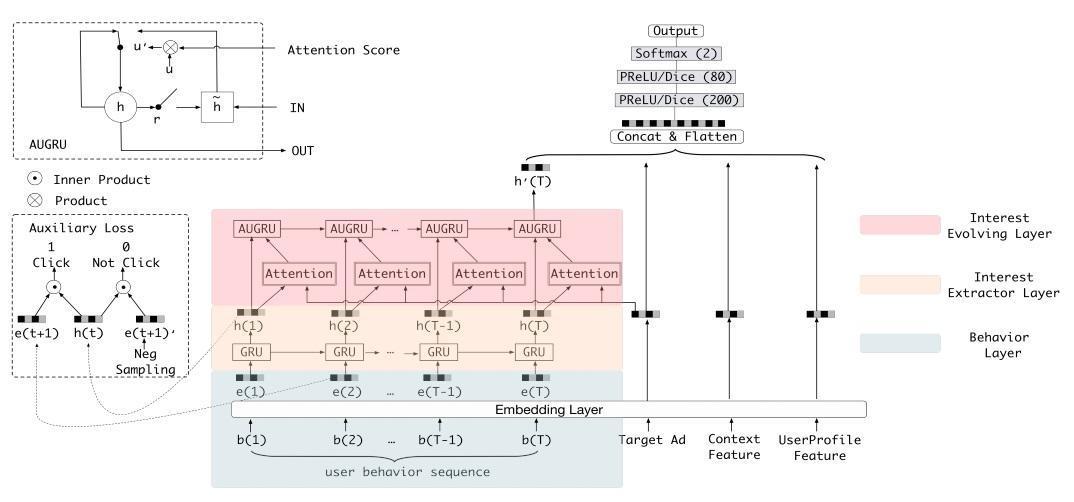

そこでこの興味が進化するプロセスをモデル化するために、新しいネットワークアーキテクチャDIENを本論文では提案しています。

以下はDIENのネットワーク構造図です。

DIENのネットワーク構造においてDINと異なる特徴が2点あります。

1つめは、ふるまいを直接興味として扱うのではなく、ユーザーの興味/関心を抽出するレイヤー(Interest Extractor Layer)を追加している点です。

2つめは、ユーザーの関心が進化するプロセスをモデル化した、興味を発展させるレイヤー(Interest Evolving Layer)が追加された点です。

この2つのレイヤーの追加により、ユーザーの潜在的な興味・関心も使用してCTR予測ができるようになりました。

DIENは、既に実運用のフェーズまで進んでおり、中国のタオバオのディスプレイ広告システムに導入され、CTRで20.7%の改善を得られたそうです。

まとめ

今回はAAAI 2019採択論文をご紹介いたしました。

マルチモーダル学習や顔認証などは近年とても人気の分野です。

今後も実運用フェーズで活躍できそうな研究成果が多く発表されることでしょう。

女子部テックブログでは今後も学会論文のサマリーや、興味深いAI論文についてピックアップしてご紹介していきますので、また次回もお楽しみに!

|

■ 本記事で特集したAI論文の出典元/Reference Lists |