こんな方におすすめの記事です

データサイエンティスト、機械学習エンジニア、人工知能について勉強をしているすべての人

この記事を読み終えるのに必要な時間

10分

はじめに

こんにちは。マクニカ AIリサーチセンターの土屋です!

最近、急に寒くなりましたね…。今回は、寒さに負けないよう、激熱のブログを投稿します。

その名も「AI系トップカンファレンスNeurIPS 2018まとめ」です。

具体的には機械学習特化型のトップカンファレンス「NeurIPS 2018はどのような学会か?」といったところから、「NeurIPS 2018から理解する今年のAIトレンド」、「NeurIPS 2018に採択された論文とチュートリアルまとめ」について説明させていただきます。

それでは早速、NeurIPS 2018についてお話させていただきます。

NeurIPS 2018とは

早速、NeurIPS 2018とは何か?ということについてですが、下表は前回のブログでもご紹介したAI系の学会の特徴をまとめたものです。

| 名前 | 詳細 | 場所 | 時期 |

|

人工知能全般 |

|||

| IJCAI | 機械学習だけでなく、AI全般の世界のトップカンファレンス | スウェーデン |

7月 |

| AAAI | IJCAIと同格のカンファレンス | ハワイ | 1月 |

| JSAI | 人工知能学会全国大会と呼ばれる日本の大会 | 鹿児島 | 6月 |

|

統計的機械学習・Deep Learning |

|||

| NeurIPS | 機械学習系のトップカンファレンス, 去年まではNIPSという名前だった | カナダ | 12月 |

| ICML | NeurIPSに並ぶトップカンファレンス, 実験重視だったが近年は理論重視型になった | スウェーデン | 6月 |

| IBIS | 日本最大の機械学習系のワークショップ | 札幌 | 11月 |

|

コンピュータビジョン |

|||

| CVPR | コンピュータビジョンのトップカンファレンス | アメリカ | 6月 |

| ICCV | CVPRに並ぶカンファレンス, 隔年開催 | イタリア | 10月 |

※2018年12月調べ。学会の時期は全て2018年のものです。

NeurIPS 2018は、2018年12月2日から8日までの期間で開催された機械学習に特化したAI系のトップカンファレンスです。

前回の「AIの最先端は論文で学ぶ」でも記しましたが、良質な論文を探すには、学会から選出するのが最短ルートです。

といっても、学会にはいくつか種類があり、学会によって特色があるので、自分に適した学会を見つけることもまた重要です。

今回は数ある学会の中でも、最近開催された機械学習特化型のカンファレンスNeurIPS 2018についてまとめさせていただきます。

ちなみに、NeurIPS 2018は大人気のため、チケットは10分で売り切れたそうです。AIブームはまだまだ来ていますね。笑

さて、前置きが長くなりましたが、続いて2018年の機械学習の技術的なトレンドについて、“把握した気になれる”画像を用意しました。

NeurIPS 2018から分かる今年のAI技術トレンド

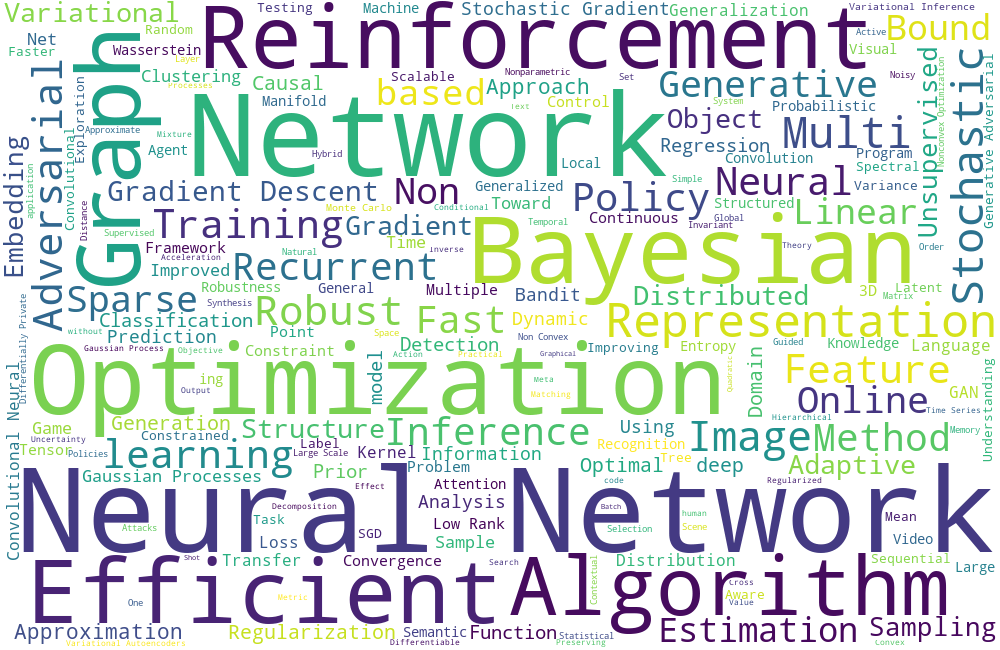

この画像は、今年の技術トレンドを把握するために、NeurIPS 2018に採択された論文1011本のタイトルを集計して、タイトルに含まれるワードが多いものを大きく表示し、少ないものを小さく表示したものです。色には全く意味はありません。

※ https://nips.cc/Conferences/2018/Schedule?type=Posterより自作しました。“via”, “using”などはたくさん使われていますが、意味のないワードは除いています。

ものすごく単純な画像ですが、機械学習のトレンドは把握した気になれましたでしょうか?

Neural Networkが一番多く含まれることはもちろんですが、他のワードにも注目ですね。

強化(reinforcement)学習、グラフ(graph)や、ベイズ(Bayesian)はやはり熱いですが、

より効率的(Efficient)な最適化(Optimization)や、その他のアルゴリズム(Algorithm)に興味のある研究は多いようです。

毎年トレンドは少しずつ変わっていますが、Deep Learning自体が歴史の浅い学問なので、今年の学会に採択された論文が2年後にはデファクトスタンダードになっているかもしれません。なのでトレンドをしっかり把握することは、やはり重要ですね。

それでは、NeurIPS 2018の論文を読んでいきましょう。と言いたいところなのですが、実は、NeurIPS 2018で、論文しか活用しないのはもったいないです。

次の項では、論文を含めるNeurIPS 2018の活用方法についてご紹介いたします。

NeurIPS 2018はTutorials とAccepted Papers から学ぶ

いままで論文にばかり注目をしていたのですが、NeurIPS 2018の活用方法は論文だけではありません。NeurIPS 2018では、Tutorialsも非常に参考になるので、率先して活用しましょう。

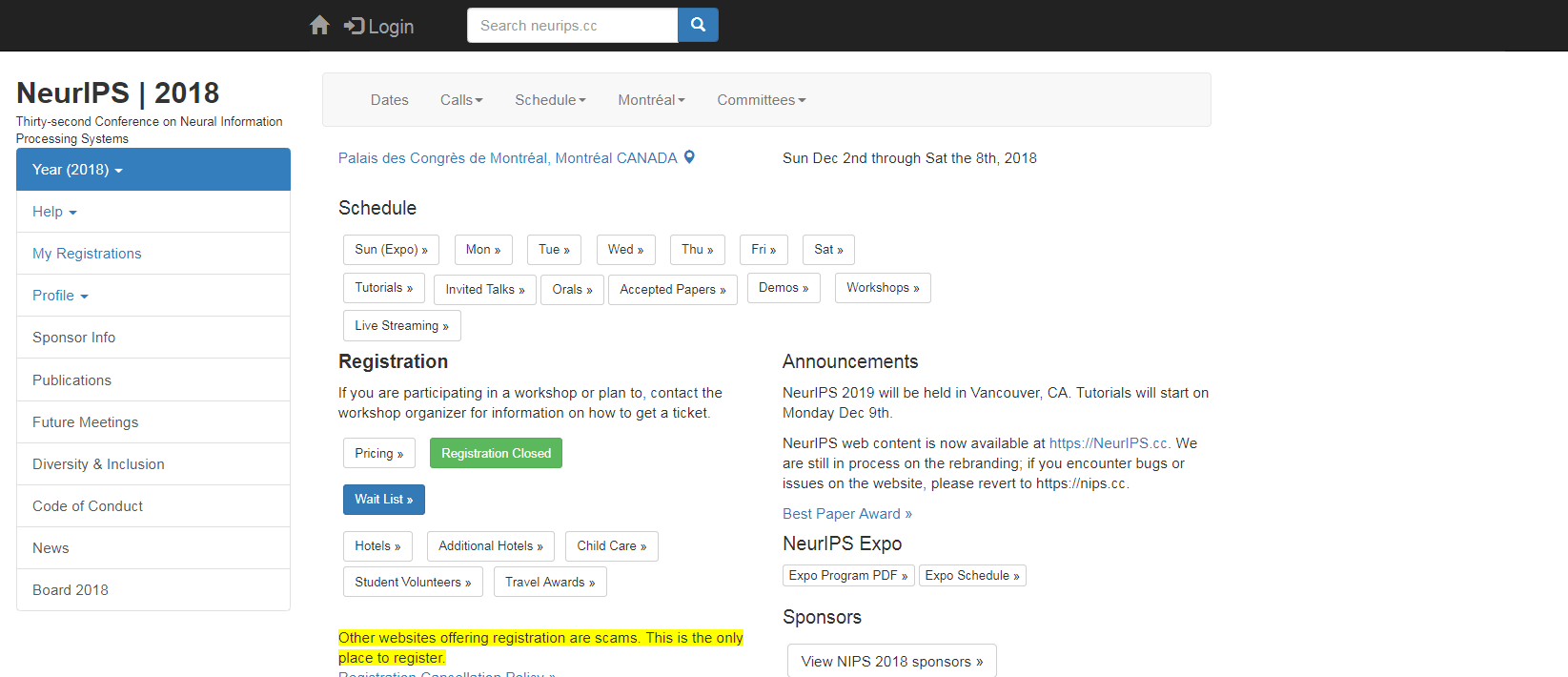

それでは、NeurIPS 2018のサイト( httnips.cc/ps:// )に訪問してください。

実際にサイトを見ても、欲しい情報が見つかりにくいと思うので、キャプチャ画像を用意しました。

(余談ですが、Kaggleしかり、海外のサイトはUXが日本のそれと全然違うので、日本人が初めて使う時に簡単に使える設計ではないですよね。)

引用:https://nips.cc/Conferences/2018より(2018.12.21作成)

Tutorialsは、最先端の情報を研究者が一般人向けにまとめてくれたものです。

'Scalable Bayesian Inference'などのタイトルのものが9つほどあります。

また、Accepted Papersは、NeurIPS 2018に採択された論文で、質の高いもののみが厳選されていますが、全部で1011本あります。

全部読みたいところですが、時間がないかと思うので、その中からさらに厳選が必要です。

「1011本なんて、全然厳選できてないじゃないか!」と思った方もいるでしょうが、この1011本という数も記録的な数で、どの年よりも採択論文は多かったようです。

それもそのはず。今年は、論文の投稿数が4854本あったそうで、その中から4分の1に厳選をした1011本が採択論文として残ることができたのです。

また、今回はすぐに活用することができなさそうだったので、抽出はしておりませんが、Student Best Paper Awards NeurIPS 2018は破壊的です。

これは4本のみなので、ご興味のある方はぜひ読んでみてください。

[参考URL]

https://nips.cc/Conferences/2018/Awards

それでは、Tutorialsから見ていきましょう。

NeurIPS 2018 Tutorials 3選

NeurIPS 2018でのTutorialsは全部で9本ありますが、どれも興味深いものばかりです。今回はその中から、3つのTutorialsを要約させていただきます。

[参考URL]

https://nips.cc/Conferences/2018/Schedule?type=Tutorial

今回まとめる3つのチュートリアルのタイトルは以下の通りです。

- Visualization for Machine Learning (機械学習のための可視化)

- Scalable Bayesian Inference (拡張可能なベイズ推論)

- Unsupervised Deep Learning (教師なし学習)

それでは早速、1つ目から見ていきましょう。

Visualization for Machine Learning (機械学習のための可視化)

[発表者]

Google Brain の PAIR(People + AI + Research)の data visualizer の Fernanda Viégas氏、同研究所の Martin Wattenberg氏

[概要]

機械学習のための視覚化方法について幅広く解説をしてくれます。

具体的には、トレーニングデータの分析、モデル内部の理解、パフォーマンステストの3つでのフェーズ別に、それぞれの視覚化手法について説明します。

本には載っていないような、さまざまな視覚化方法がありますので、説明方法に困っていて最先端の解析案件での可視化方法全般を知りたいというニーズがある方におすすめです。

[Tutorial URL]

https://nips.cc/Conferences/2018/Schedule?showEvent=10986

Scalable Bayesian Inference (拡張可能なベイズ推論)

[発表者]

計的方法論開発における権威、デューク大学の教授 David Dunson氏

[概要]

サンプルデータが非常に大きいデータ、非常に高次元のデータに対するアプローチを説明します。

具体的には、ラプラス法やベイジアン中心極限定理などのサンプルサイズが大きい際の古典的な手法の見直しから、一般的に使われるマルコフ連鎖モンテカルロ法を拡張するための概念的かつ実用的なアプローチを説明します。

なお、こういった手法は、計算広告やゲノミクス、神経科学などのさまざまな領域で応用されています。

[Tutorial URL]

https://nips.cc/Conferences/2018/Schedule?showEvent=10984

[動画URL]

https://videos.videoken.com/index.php/videos/scalable-bayesian-inference-neurips-2018/

Unsupervised Deep Learning (教師なし学習)

[発表者]

Deep Mind の研究者 Alex Graves氏、Facebook AI Research Lab の Marc’ Aurelio Ranzato氏

[概要]

Deep Neural Networkは膨大な量のラベルなしデータの活用方法として活用されていますが、目的関数の設定をすることが難しいという課題があります。このチュートリアルでは、確率モデルによって全データを予測することで、その課題にアプローチします。

また、応用的な例としては、自己監督型アルゴリズム、エネルギーベースモデル、GANなどの生成モデルに焦点をあてて、学術的な論点から実践的なアプローチまでの解説を行います。

[Tutorial URL]

https://nips.cc/Conferences/2018/Schedule?showEvent=10985

NeurIPS 2018 Accepted Papers 5選

NeurIPS 2018の採択論文は全部で、1011本あり、各々の論文はそれなりに尖っているので、今回は皆さんに関わりがあるかもしれない、あまり尖り過ぎていない論文を5本ほど抽出して内容をまとめさせていただきました。

今回まとめる論文は以下の5本です。

- Pelee:A Real-Time Object Detection System on Mobile Devices(PeleeNet:モバイル端末で動くリアルタイムオブジェクトディテクションシステム)

- Deep Anomaly Detection Using Geometric Transformations(幾何変換を用いたDeep Anomaly Detection)

- Evolutionary Stochastic Gradient Descent for Optimization of Deep Neural Networks(深層ニューラルネットワーク最適化のための進化的確率的勾配降下)

- Representer Point Selection for Explaining Deep Neural Networks(ディープニューラルネットワークを説明するための代表点の選択)

- Supervising Unsupervised Learning(監督された教師なし学習)

それでは、1つずつ要約をしていきます。

Pelee:A Real-Time Object Detection System on Mobile Devices(PeleeNet:モバイル端末で動くリアルタイムオブジェクトディテクションシステム)

[概要]

少ないコンピュータリソース(モバイル端末など)でもConvolutional NNを実行したいというニーズはあり、MobileNet, ShuffleNet, MobileNetV2 などが採用されてきましたが、今年は PeleeNet というネットワークが NeurIPS 2018 に採択されました。

この分野では、評価指標は速さと精度、軽さ(パラメータの少なさ)等がありますが、これらの評価指標において他のネットワークと比べ優位な結果が出ています。

[arXiv URL]

https://arxiv.org/abs/1804.06882

[GitHub URL]

https://github.com/Robert-JunWang/Pelee

Deep Anomaly Detection Using Geometric Transformations(幾何変換を用いたDeep Anomaly Detection)

[概要]

異常検知(anomaly detection)といえば、AutoEncoder による手法などがトレンドですが、この論文では、幾何変換を適用することを提案します。

具体的には、幾何変換した画像を訓練することで、幾何学的特徴を学習することができ、それらが異常データかどうかを分類する仕組みに関する提案です。

結果としては、CIFAR-10, CIFAR-100, Fashion-MNIST, CatsVsDogs の全てのデータセットに関して、one-vs-all のスキームで、既存手法と比較した時のAUROCが大きく改善されました。

[arXiv URL]

https://arxiv.org/abs/1805.10917

[GitHub URL]

https://github.com/izikgo/AnomalyDetectionTransformations

Evolutionary Stochastic Gradient Descent for Optimization of Deep Neural Networks(ディープニューラルネットワーク最適化のための進化的確率的勾配降下)

[概要]

Evolutionaryと聞いて、「進化したSGD(確率的勾配降下法)なのか?」と思った方がいるかもしれませんが、そういうわけではありません。Evolutionary Stochastic Gradient Descent(進化的確率勾配降下法)は、既存のSGD(確率勾配降下法)と、集団ベース探索の並列処理を行う進化的(Evolutionary)アルゴリズムを組み合わせたものになります。

この最適化手法は、さまざまなタスクにおいて有効で、実際に、音声認識、画像認識、自然言語処理などのすべてのネットワークで有効であることが検証によって示されました。

[arXiv URL]

https://arxiv.org/abs/1810.06773

Representer Point Selection for Explaining Deep Neural Networks(ディープニューラルネットワークを説明するための代表点の選択)

[概要]

近年、機械学習は多くの場所で使われていますが、予測の精度や速さだけでなく「なぜその予測をしたのか?」といったことに焦点を当てた研究が増えています。

この論文は、その研究のうちの一成果で、トレーニングセットの代表点と呼ばれる箇所に着目することで、ニューラルネットワークの予測を説明するための提案をしました。

アイデアとしては、Pre-Activationのニューラルネットワークによる予測値が、代表点の値と呼ばれるものの線形結合であらわすことができるようになり、そうすることで、トレーニングポイントの重要な点を把握できるようになるというものです。

[arXiv URL]

https://arxiv.org/abs/1811.09720

Supervising Unsupervised Learning(教師なし学習の監督)

[概要]

教師なし学習は、アルゴリズムの性能を評価するための方法がなく、パフォーマンスを評価することが非常に困難であることが問題視されています。

この論文では、Meta Unsupervised Learning(MUL)を使うことで、それを改善させる試みをします。具体的には、異なるラベル付けがされたデータセットのリポジトリで、教師あり学習をして得た知識を、新しい教師なし学習に適応させるフレームワークの考案を行います。

結果的に、実験ではシンプルなアルゴリズムの教師なし学習でのパフォーマンスが高くなることがわかりました。

[arXiv URL]

https://arxiv.org/abs/1709.05262

まとめ

タイトルにあるとおり、今回はAI系のトップカンファレンスである NeurIPS 2018 についてのまとめ投稿をさせていただきました。

また、今回はあまり尖り過ぎていない内容の論文を抽出しましたが、尖った論文もたくさんありますので、ぜひ一度、NeurIPS 2018 の採択論文ページ(https://nips.cc/Conferences/2018/Schedule?type=Poster)をチェックしてみてください。

また、次回のブログでは、論文の実装をして、どれだけ有用なものかを検証させていただこうと思いますので、よろしくお願いいたします。